Les fameuses lunettes Google Glass, ou montures de réalité augmentée, font toujours parler d'elles, forcément puisqu'elles sont désormais dans les mains d'un nombre limité de développeurs triés sur le volet. C'est à ce jour le seul projet ouvert et non-secret d'un des géants autour de telles lunettes. On attend en revanche un certain nombre de smartwatches (« ordimontres » ?) desdits géants.

Sommaire

Voici donc les détails glanés lors des dernière semaines d'actualité des montures.

Logiciel

La première bonne nouvelle pour les Google Glass, le code source du noyau Linux a été reversé, sous licence GPLv2 évidemment. On s'y attend un peu en même temps. Et ces sources du noyau devront bientôt être poussées sur android.googlesource.com. Il s'agit d'OS basé Android 4.0.4 ou Ice Cream Sandwich pour les intimes. Cela permet donc de débugguer via ADB. On attend également le reversement d'au moins une majeure partie de ce code dérivé, toujours sous sa licence Apache 2.0.

Matériel

Ensuite, on connait un peu mieux ce que ce nouveau type de vêtement communicant (en anglais wearable computing) embarque : un SoC (System on Chip) Texas Instrument OMAP 4430. C'est un processeur double-cœur, architecture ARMv7, fréquence 1 GHz, doté de 682 Mo de mémoire vive et de 16 Go de stockage.

De plus, la caméra vidéo permet une définition HD de 720p ou 5 Mp. Pour l'affichage, proche de l'oeil droit et transparent, cela équivaut à un écran de diagonale de 25 pouces vu avec un recul de 2,4 m : la résolution est de 640 x 360 pixels donc un rapport de 16x9. Il y a une prise en charge du conteneur MP4 et des codecs vidéo H.264 baseline et H.263 baseline. Le son se repose sur le principe de conduction osseuse ou ostéophonie, et prend en charge les codecs audio AAC et MP3.

Elles embarquent également le wifi 802.11g et le Bluetooth. La batterie, elle, durerait un jour. Le connecteur micro-USB est présent.

Ces spécifications et versions ne sont pas des plus « récentes » (lire « pas impressionnantes ») , mais on s'y attend, étant donné la taille de l'appareil.

Hacktuel

Jay Ryan Freeman, le développeur de Cydia l'application open source d'AppStore pour appareil iOS déverrouillés (« _jailbreakés_ »), a fait savoir qu'il avait également déverrouillé ses Glass. Apparemment, ce fût facile car d'autres l'ont fait également sans mal. Chez Google, on dit que cette facilité est intentionnelle.

Glassware

La documentation développeur (en version « Developer Preview ») est assez claire quant à l'interface utilisateur.

Interfaces d'entrée/sortie

Les sorties des Glass sont d'une part le petit écran transparent situé en haut à droite de l'oeil droit (projection par prisme, hors du champs de vision, il faut lever l'oeil pour lire l'écran) et d'autre part le son, diffusé par conduction osseuse depuis les branches.

Les entrées sont la voix de l'utilisateur, donc reconnaissance vocale, encore peu fiable, et aussi un mini pavé tactile (« touchpad ») sur la branche droite à hauteur de la tempe de l'utilisateur. Ce dernier permet de taper (sélectionner) et balayer (« swipe »).

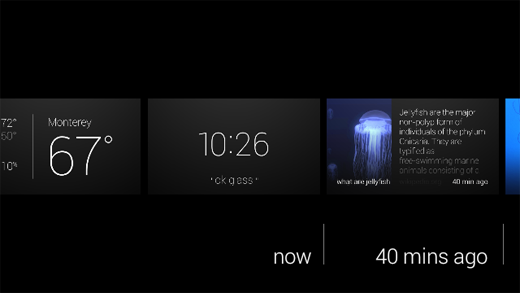

Ligne chronologique

Ici, pas de lanceur (« home » ou « launcher »), il s'agit d'une timeline, ligne chronologique contenant une collection de cartes, qui sont des services web. Ces cartes peuvent contenir du texte, du HTML, ou bien des images ou de la vidéo sous forme d'attachement.

Une carte peut aussi être un regroupement / bundle, c'est-à-dire une carte qui contient une sous-timeline avec des cartes. Un bundle est marqué en haut à droite par un repli façon papier.

Un utilisateur peut donc naviguer dans une ligne chronologique en balayant du doigt droit (c'est dur à dire), entrer dans un bundle en tapant, et sortir d'un bundle en balayant vers le bas.

Les cartes restent 7 jours sur les Glass de l'utilisateur, et 30 jours sur les serveurs Google.

Menus

Les menus sont liées à des cartes. Elles permettent de faire lire la carte à voix haute aux Glass, de répondre par la voix utilisateur et de naviguer, ou même de créer des actions spécifiques.

Notifications

Il s'agit ici de notifications pour les développeurs, notifiant les infos d'interaction utilisateur : le choix d'entrée de menu ou de partage avec un contact. Il ne s'agit pas des notifications pour l'utilisateur, celles lisibles en tirant du doigt depuis le haut de l'écran sur un Android classique.

L'idée est donc de souscrire à une carte, donc pas besoin de polling (scrutation), c'est du push. Il faut fournir une URL de callback et un token (jeton).

Partage

Le partage de carte peut se faire vers des contacts, ou d'autres cartes. Pour qu'une carte puisse recevoir des partages, il faut l'inscrire comme dans la collection de contacts. Une Glassware ne pouvant que lire les cartes et bundles qu'il a créés.

Localisation

La localisation est utilisable dans les cartes et menus, si l'utilisateur l'a autorisé.

Mirror API

Il s'agit d'un service web RESTful par Google. Il se place entre votre service web et les Glassware, pas sûr de comprendre pourquoi, si quelqu'un pouvait expliquer. Il se repose sur OAuth 2.0. Des bibliothèques existent en Java, Python et PHP.

Guidelines

Elles se résument ainsi :

- Concevoir pour Glass

- Ne pas déranger

- Consever la notion d'immédiateté (proximité temporelle)

- Éviter l'inattendu

Terrain de jeu

Vous pouvez vous amuser avec des exemple de cartes modifiables sur le terrain de jeu.

Relationnel

Google encourage bien évidemment les développeurs à produire du Glassware…

Des développeurs vont-il modifier la ligne chronologique fournie par Google, pour faire l'équivalent de lanceurs (« launchers ») alternatifs, si prisés sur Android ? Va-t-on aller plus loin et voir des distributions (ROM) alternatives comme Cyanogen ?

Aller plus loin

- Source du noyau Google Glass (107 clics)

- Documentation développeur (52 clics)

- ars technica : Google releases Glass source code, declares platform open to hackers (66 clics)

# suivi de l'oeil ?

Posté par Nicolas Boulay (site web personnel) . Évalué à 5.

Dans une vidéo commercial, il semblait que l’œil était suivi pour faire les détections. Est-ce le cas ? Ou est-ce simplement un gyroscope, qui ne répond donc qu'au mouvement de la tête ? Est-ce que la résolution faible n'est pas gênante ?

"La première sécurité est la liberté"

[^] # Re: suivi de l'oeil ?

Posté par Nÿco (site web personnel) . Évalué à 4.

À ma connaissance, pas de détection de mouvements d'oeil, mais effectivement un gyro, car tu peux soit activer tes Glass avec un tap sur le touchpad ou via un geste de la tête, par défaut lever la tête de 20°, mais paramétrable.

La résolution ne semble pas un frein, d'après tous les tests que j'aie pu lire.

[^] # Re: suivi de l'oeil ?

Posté par Sam E. (site web personnel) . Évalué à 4.

Apparemment les Glass peuvent détecter un clignement de l'oeil :

http://glass-apps.org/winky-google-glass-app

C'est faisable sans tracking ?

# Sombre futur

Posté par roduit (site web personnel) . Évalué à 10.

A part le côté ludique de ce genre d'outil, cela me fait quand même relativement peur sur l'avenir que cela réserve…

Comment vais-je réagir dans la rue si je m'attends à ce que quelqu'un ait ces lunettes ? Serais-je vraiment naturel ?

Pourquoi diable l'état a-t-il dépensé tant d'argent dans des caméras de vidéo surveillance ? Un simple accès aux lunettes (GPS + connexion) permettrait, théoriquement, d'avoir accès à tout le territoire…

Mais en fait, je n'ai rien à cacher, moi. Pourquoi me poserais-je de telle questions ?

[^] # Re: Sombre futur

Posté par Nÿco (site web personnel) . Évalué à 4.

Même problème avec les dashcams en Russie, activées par défaut sur tous les tableaux de bord. C'est comme ça d'ailleurs qu'on a eu plein d'image de la météorite (et aussi des milliers de « fails » sur les YouTube et compagnie).

Même problème ? Peut-être pas : les dashcams ne sont utilisées que par les assurances (?), alors que Google va utiliser un max tes données pour vendre sa pub, car oui c'est une boîte de pub.

[^] # Re: Sombre futur

Posté par Nicolas Boulay (site web personnel) . Évalué à 2.

Si c'est tellement un problème, il suffit d'interdire à Google de faire un traitement déporté de la vidéo sur ces serveurs, comme le il le font pour la commande vocale.

"La première sécurité est la liberté"

[^] # Re: Sombre futur

Posté par Aissen . Évalué à 4.

Il me semble qu’il s’agit de commandes vocales, et non de reconnaissance vocale (sauf pour la recherche). Ces commandes sont assez basiques, et volontairement restreintes, et seraient donc analysées hors ligne.

[^] # Re: Sombre futur

Posté par Mme Michu-cide . Évalué à 2.

Avec la reconnaissance vocale, écriture et oculaire, il restera quoi avant qu'on puisse dupliquer ta "signature" et en faire ce qu'on veut, une simple référence dans une DB.

Du coups, je n'utilise pas les fonctionnalités vocales même si ça pourrait être une interface entrée très intéressante quand celle-ci est "au point".

[^] # Re: Sombre futur

Posté par bubar🦥 . Évalué à 4.

téléchargeregarde «Black Mirror» (saison, l'épisode 3, ce sont des histoires indépendantes, 3 visions de futurs) : c'est excellent ;)# vocabulaire

Posté par Adrien . Évalué à 3.

Je dois veillir, mais pas compris le sens de la phrase (« reversé » n'a pas l'air d'exister dans le dico). Le code était non-libre et Google l'a libéré ? Le code a toujours été libre ? Le code était libre, mais il est désormais intégré au noyau Linux ? ou alors intégré à Android ? Mais alors à quoi correspond le code « dérivé » ? La licence c'est GPLv2 ou Apache ?

Et c'est juste le code du noyau ou bien tout le reste (je suppose qu'il y a une interface)

Bref, si quelqu'un veut bien m'éclairer j'en serais reconnaissant.

[^] # Re: vocabulaire

Posté par Nÿco (site web personnel) . Évalué à 9.

En fait, Google développe dans son coin en secret la version suivante, la diffuse en binaire, puis livre le code source. C'est donc un développement fermé à sources ouvertes a posteriori. La gouvernance est totalement opaque.

[^] # Re: vocabulaire

Posté par CrEv (site web personnel) . Évalué à 5.

Le truc c'est qu'avec une GPL absolument n'oblige à fournir le code source utilisé… à quelqu'un d'autre que l'utilisateur du logiciel (et encore, ça peut être uniquement sur demande et pas nécessairement gratuit)

Donc si on suit strictement la licence Google n'est pas obligé de publier le code source, quant bien même il est sous GPL.

Et comme le dit Nÿco, ils développent dans leur coin (ils peuvent) et ils ont décidé de rendre publique leur code.

En fait c'est là qu'on voit qu'un développement peut être fait sous licence libre (c'est le cas ici) mais de manière non communautaire. (et d'ailleurs on peut aussi avoir l'inverse suivant la licence)

[^] # Re: vocabulaire

Posté par lejocelyn (site web personnel) . Évalué à 2.

(« reversé » n'a pas l'air d'exister dans le dico) Autant dire que reversé ne semble pas exister dans le dictionnaire relève de la mauvaise foi et de la flemme (je n'ai pas trouvé un dictionnaire dans lequel il n'existait pas), autant son utilisation dans le cas présent est bien maladroite. Qui n'a pas tort ? qui n'a pas raison ? je ne saurais de ne pas le dire.

Au début, j'y avais même vu un anglicisme du terme "reverse", mais ça ne fonctionne pas non plus. En fait, «reverser» est généralement transitif, c'est ce qui doit choquer dans cette tournure de phrase.

[^] # Re: vocabulaire

Posté par gueux . Évalué à 2.

En même temps, "le code source du noyau Linux a été reversé", c'est transitif… :) "On a reversé le code source du noyau Linux"… La phrase est parfaitement correcte selon moi.

# Un méchoui ? Tu pipeautes pas un peu, toi ?

Posté par Sam E. (site web personnel) . Évalué à 1.

C'est pas ce qu'il dit sur son site :

http://www.saurik.com/id/16

Il y explique comment il a réussi à obtenir un accès root via une faille d'Android.

[^] # Re: Un méchoui ? Tu pipeautes pas un peu, toi ?

Posté par Nÿco (site web personnel) . Évalué à 5.

Je n'ai pas écrit quoique ce soit concernant ses dires. Mais merci pour le lien.

[^] # Re: Un méchoui ? Tu pipeautes pas un peu, toi ?

Posté par Sam E. (site web personnel) . Évalué à 2.

C'est cette phrase qui m'a fait réagir :

# Pas de réalité augmentée ?

Posté par Yarma22 . Évalué à 6.

Ah je n'avais pas compris que ça fonctionnait sur ce principe. Du coup il ne sera possible de faire des applis de réalité augmentée, en superposant des informations sur ce que voit réellement l'utilisateur ?

Par exemple j'imaginais bien des serveurs au resto avec ce type de lunettes. Ils auraient pu voir, en balayant la salle du regard, quel client attend quel plat et depuis combien de temps !

[^] # Re: Pas de réalité augmentée ?

Posté par Yao Kuramoto . Évalué à 3.

Ah zut… j'aurais donc pas de clavier en réalité augmenté … dommage, j'attendrais la v2 alors.

[^] # Re: Pas de réalité augmentée ?

Posté par Sam E. (site web personnel) . Évalué à 3.

C'est aussi ce que j'avais cru comprendre en voyant le première vidéo présentant le projet :

http://www.youtube.com/watch?v=9c6W4CCU9M4

Apparemment ils se sont tourné vers quelque chose de moins dérangeant visuellement (faut dire que dans cette vidéo certaines popup obstruent carrément la vue), mais qui du coup me semble moins intéressant.

Si on regarde la page du projet actuel, à part prendre des photos, enregistrer des vidéos et obtenir des informations anecdotiques (heure, taille d'un pont, etc.) ça n'apporte pas grand chose :

http://www.google.com/glass/start/what-it-does/

[^] # Re: Pas de réalité augmentée ?

Posté par bubar🦥 . Évalué à 3.

Effectivement ça ne semble rien apporter de réellement intéressant pour le moment. Un vague mouvement (sur g+) pour en faire des dashcams àlarusse mais plus libres pour le porteur, …. hum, ça reste moins intéressant qu'un hud bricolé. De plus les Google-Glass sont d'ores et déjà interdites dans certains endroits aux usa. Enfin il y a qq strips mettant en lumière sous formes humouristiques des usages auxquels on ne pense pas de prime abord, mais qui devraient rapidement devenir assez énervants, voir insupportables "irl"

Le poignet est l'emplacement roi, dédié depuis bien longtemps à des montres, souvent bijoux elles mˆemes. Emplacement en berne devant l'inutilité des montres actuellement, devenues uniquement bijou faire-valoir. L'emplacement roi, libre… hum… Une impression de refaire un commentaire d'il y a dix ans "icitte meme" …

Mais c'est sans compter les usages professionnels. Il semble moins intrusif d'obtenir des informations de manière visuelle qu'auditive. Ce dernier canal acquérant l'attention (difficile de suivre deux infos auditives en meme temps), quant l'oeil le permet. Il est donc fort probable que l'on voit rapidement des usages professionnels réellement pratiques pour les Gglasses du fait de la non-intrusivité (pas de bruits, pas de mains occupés, attention très furtive), que cela soit pour l'info vers décisionnel comme pour décisonnel vers acteurs, mais aussi lors de réunions, rencontres.

Bref, personnellement, je ne serais pas surpris que ça prenne doucement et surement (comme g+) tandisque les montres-ng seront plus grand public. wait and see

??

[^] # Re: Pas de réalité augmentée ?

Posté par bubar🦥 . Évalué à 3.

Superbe idée, mais plutot que qq chose de complet comme une superposition en réalité augmenté s'adaptant à la position du porteur et à la position des cibles, quelque chose de plus simple comme "table X, plats prets" sera moins consommateur d'énergie, moins intrusif pour le porteur, plus facile a mettre en oeuvre, pour une meme efficacité.

Bonus probable : plus de calme en salle, pour le personnel et la clientèle.

Ton idée risque de marcher fort :-)

[^] # Re: Pas de réalité augmentée ?

Posté par Yarma22 . Évalué à 2.

Merci. L’idée est libre de droits si jamais ça intéresse quelqu'un !

C'est tout de même dommage pour la réalité augmentée, on va devoir patienter encore un peu avant de devenir des cyborgs ;-)

# Ils fontla même pour gauché

Posté par Guillaum (site web personnel) . Évalué à 4.

De l'oeil ?

J'ai un œil droit plutôt mauvais et un œil gauche de pilote de chasse, alors c'est un peu dommage que la vidéo soit à droite…

Enfin bon, cela me motivera pour me faire opérer // aller chez l'ophtalmo.

[^] # Re: Ils fontla même pour gauché

Posté par Nÿco (site web personnel) . Évalué à 3.

Si j'ai bien compris, ils bossent avec des fabricants de lunettes et montures. Je suppose donc qu'il y aura plusieurs designs.

À ce stade, c'est encore pre-alpha. Mais je ne peux pas croire qu'ils n'adressent pas le marché des gauchers de l'oeil (on dit comme ça ?).

Suivre le flux des commentaires

Note : les commentaires appartiennent à celles et ceux qui les ont postés. Nous n’en sommes pas responsables.