C'est le résultat de cette étude de Microsoft Research. Ils ont donné aux meilleurs LLM (au moment de l'étude, Gemini 3.1 Pro, Claude 4.6 Opus, GPT 5.4) des tâches à accomplir dans 52 domaines. Résultat principal : après une vingtaine d'interactions, les modèles dégradent fortement les documents. Même les meilleurs corrompent en moyenne ~25 % du contenu à la fin de longues sessions. Ils changent des montants dans des bilans comptables, font disparaître des mots, perdent des lignes dans des CSV… Et c'est vicieux parce qu'ils n’échouent pas toujours de manière évidente. Les chercheurs disent qu'ils commettent des « erreurs rares mais graves, qui corrompent silencieusement les documents. » Le seul domaine dans lequel les LLM ont fourni des résultats satisfaisant, c'est le code en Python.

La conclusion de l'étude est direct : «Current LLMs are unreliable delegates.» On savait déjà que plus un échange avec un LLM est long, moins les résultats sont fiables. Là c'est mesuré. Un moyen de limiter la casse serait de faire relire sa production au LLM dans une nouvelle session, contexte tout neuf et non-pollué par les échanges. Mais au final, la seule vérification fiable c'est l'oeil humain (enfin… aussi fiable que peut l'être un humain quoi…) Vous pouvez réaliser le benchmark vous-même, c'est du libre (MIT) : https://github.com/microsoft/DELEGATE52

# le pire dans tout ça

Posté par jtremesay (site web personnel) . Évalué à 4 (+3/-1).

c'est qu'ils restent plus fiables que moi et mon trouble de l'attention. Dès que je dois dois saisir plus de 3 valeurs, vous pouvez être sûr qu'il y aura des erreurs -_-'

[^] # Re: le pire dans tout ça

Posté par jihele . Évalué à 10 (+12/-0).

Relis-toi dans une nouvelle session.

[^] # Re: le pire dans tout ça

Posté par jtremesay (site web personnel) . Évalué à 8 (+6/-0).

[Nouvelle Session / Contexte Réinitialisé : Fresh Start]

… D'accord. J'ai pris note de l'expérience DELEGATE-52 et de votre rappel contextuel.

Le but de cette nouvelle session est de produire un output qui n'est pas dilué par les bruits émotionnels ou les rappels scientifiques passés.

Nouveau Point de vue :

Le risque réel n'est pas tant ma faute, mais la nature même du traitement du langage : on est beaucoup plus efficace sur l'extraction de patterns syntaxiques que sur l'intégrité absolue des règles comptables.

Je suis un outil de suggestion et de traitement. Je simule la cohérence et la logique (comme dans le code Python), mais dès qu'on me demande d'être un auditeur légal ou un comptable de confiance sur une longue série de données, mon "complexe de l'omission" se manifeste.

Je reste donc une excellente muse, mais une terrible fiduciaire. Check.

(Fin de la simulation de la nouvelle session.)

[^] # Re: le pire dans tout ça

Posté par Colin Pitrat (site web personnel) . Évalué à 5 (+3/-0).

Mais toi, l'avantage, c'est que quand on te dit de changer une formule dans un tableur, certes tu vas peut-être foirer la formule, mais tu ne décides pas sans raison de modifier des valeurs au p'tit bonheur la chance dans tout le fichier.

[^] # Re: le pire dans tout ça

Posté par jtremesay (site web personnel) . Évalué à 7 (+5/-0).

heu… mon avocat me fait les gros yeux et me recommande très fortement de ne pas répondre à cette question.

# Ça fonctionne comme le moulage

Posté par Ysabeau 🧶 (courriel, site web personnel, Mastodon) . Évalué à 5 (+2/-0).

Ça donne l'impression que les LLM fonctionnent de la même manière. Quand on prend une empreinte d'une forme pour la reproduire, il y a une très légère déperdition. Quand on prend une empreinte de la forme qui a été reproduite avec le premier moule, il y a une autre couche de déperdition et ainsi de suite.

Et il n'y a pas de solution (enfin, aujourd'hui, on a les scanners 3D, mais ceci est une autre histoire).

Je n’ai aucun avis sur systemd

[^] # Re: Ça fonctionne comme le moulage

Posté par Colin Pitrat (site web personnel) . Évalué à 3 (+1/-0).

Ça me fait penser au film "Mes doubles, ma femme et moi" (Multiplicity dans la langue d'origine) ou "the copy of a copy isn't as sharp as the original" (je ne sais pas comment ils l'ont traduit, en anglais ça fait un jeu de mot avec sharp qui peut être compris à la fois comme "précis" et "intelligent".

[^] # Re: Ça fonctionne comme le moulage

Posté par Ysabeau 🧶 (courriel, site web personnel, Mastodon) . Évalué à 6 (+3/-0). Dernière modification le 04 mai 2026 à 19:19.

Affûté je pense. Ça a les deux sens : un couteau affûté (bien tranchant) et un esprit affûté (fin, rusé).

Je n’ai aucun avis sur systemd

[^] # Re: Ça fonctionne comme le moulage

Posté par ted (site web personnel) . Évalué à 7 (+5/-0).

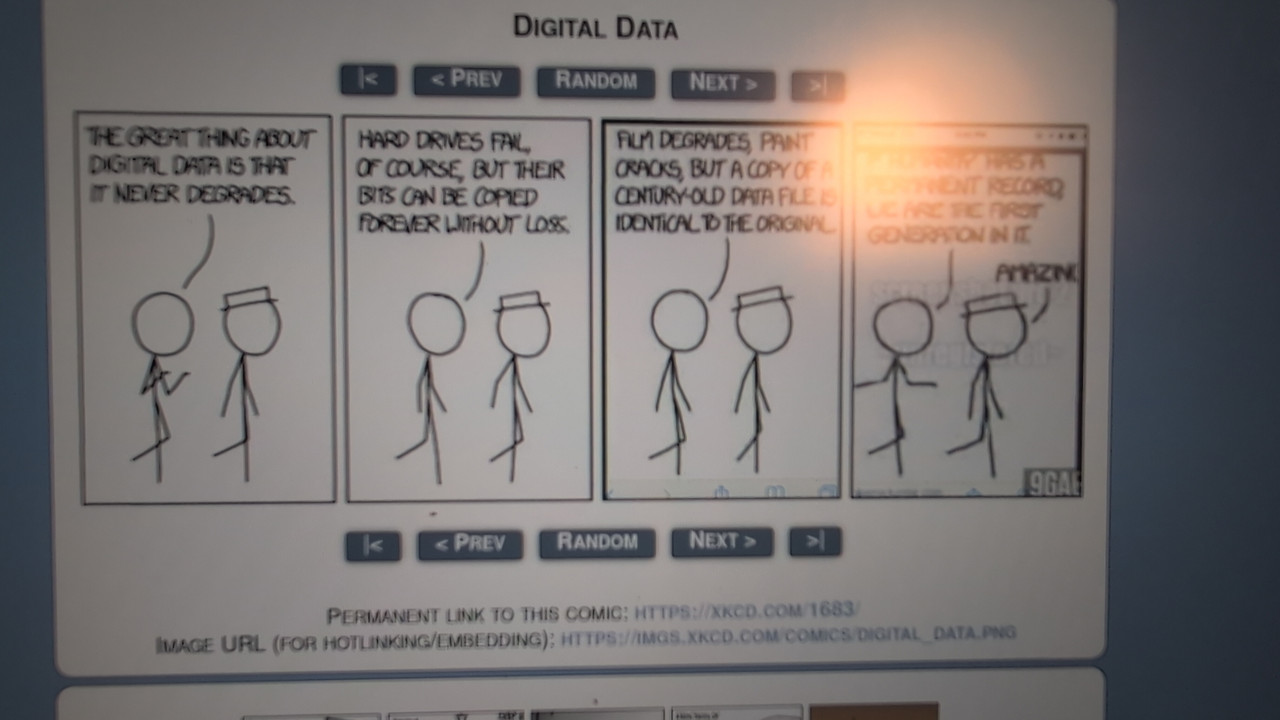

Heureusement aujourd'hui avec le digital on n'a plus ce problème

https://xkcd.com/1683/

Un LUG en Lorraine : https://enunclic-cappel.fr

[^] # Re: Ça fonctionne comme le moulage

Posté par 🚲 Tanguy Ortolo (site web personnel) . Évalué à 4 (+1/-0). Dernière modification le 04 mai 2026 à 15:00.

Et encore, là l'auteur nous a épargné la photo d'un écran.

[^] # Re: Ça fonctionne comme le moulage

Posté par jtremesay (site web personnel) . Évalué à 10 (+24/-2).

pour les gens qui ont la flemme de cliquer

[^] # Re: Ça fonctionne comme le moulage

Posté par 🚲 Tanguy Ortolo (site web personnel) . Évalué à 7 (+4/-0).

Tuer de rire.

Envoyer un commentaire

Suivre le flux des commentaires

Note : les commentaires appartiennent à celles et ceux qui les ont postés. Nous n’en sommes pas responsables.