Il donne pas mal de programmes, d'infos, de check à faire etc etc..

Je suis sûr de la présence de certaines lettres, de la longueur maximale (et j'ai une limite basse aussi)

Là, il faut un autre programme qui va te générer un dictionnaire. John dispose d'un langage spécifique permettant de générer des candidats à partir de règle. Par exemple:

-Je pars d'un mot du dictionnaire

-Je remplace les o par des 0

-J'ajoute le suffix '555!!!' systématiquement

etc etc

John va être capable de te générer un dictionnaire basé sur ces règles. Hashcat à des options équivalentes. Une fois que tu as le dico, tu peux lancer le bruteforce avec l'outil le plus adapté. Ensuite, modifie subtilement ton dictionnaire, ajoute de la force brute, etc etc..

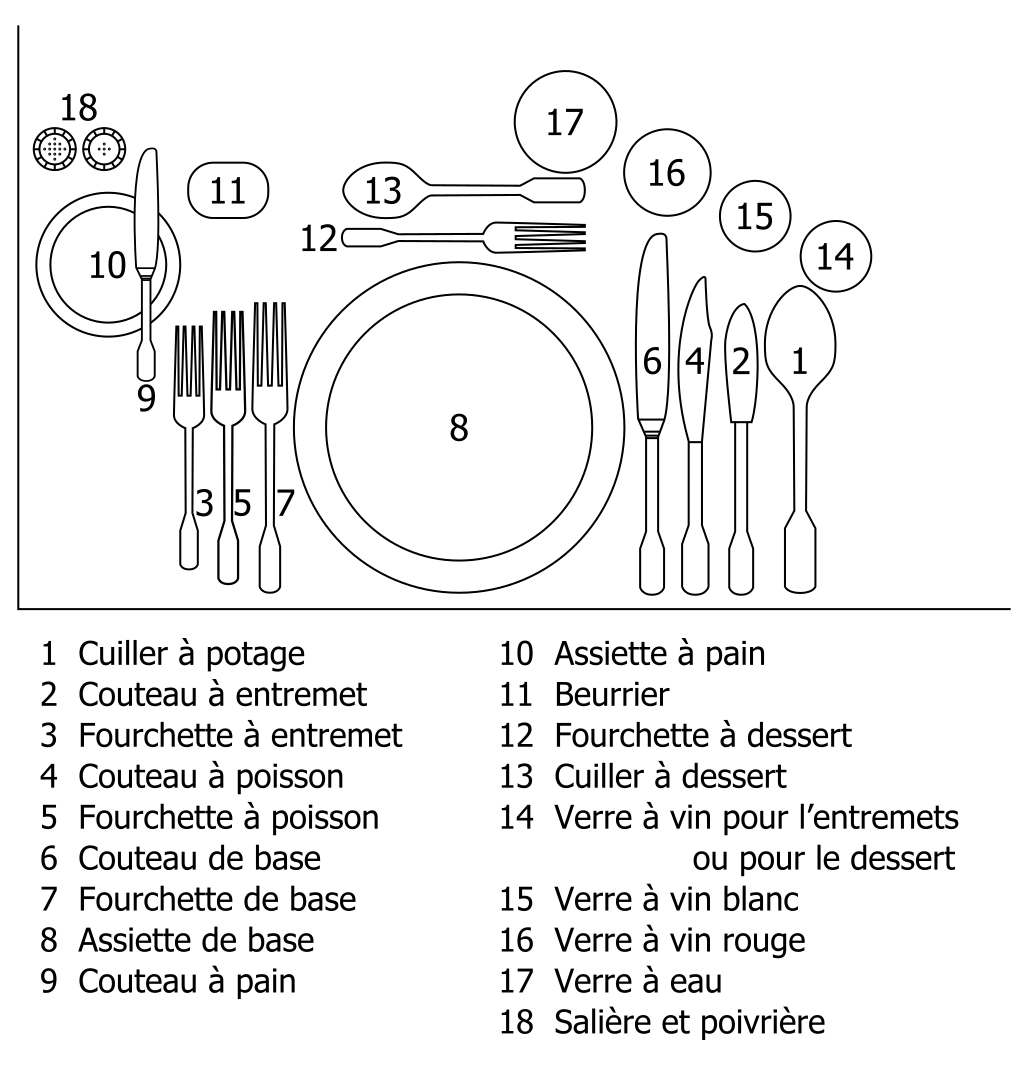

Donc je disais juste qu'il faut du coup faire attention à sa propre image mentale d'une assiette et des couverts.

Oui, je pense que j'ai surinterprété le message du posteur initial. Je pensais qu'il proposait le couteau et l'assiette à tout le monde pour faire 10. D'où problème, si on s'adresse à tous on a besoin d'un référentiel commun. Et pour la position du couteau on doit se baser du coup sur un référentiel pour partager l'image, et le seul référentiel possible qui est "les arts de la table" ne correspond pas à un 10. Mais à la relecture, je pense que le posteur originel ne parlait que de sa propre image mentale, et du coup, ça fonctionne (pour lui).

Pour finir, l’immense avantage de ce mode de communication, c’est que toute personne peut se volatiliser en un claquement de doigts et pendant le temps qu’il veut.

Et que c'est un des derniers sites web sans pub envahissante, sans 10000 trackers, sans inscription avec un téléphone qui te permette de mouler tranquillement avec un pseudo. J'ai pu troller gentiment sans risquer que mon employeur tombe dessus, et ça, c'est essentiel.

Je peux ptêt ajouter ma pierre à l'édifice. J'aim(ais)e bien la tribune, la twibioune, l'incubateur d'excellence. Ca trollait gentiment, ça posait des questions techniques de temps en temps, on avait un ancrage légèrement à gauche (youpi), et ça discutait. Puis bon, on a eu droit à des retwitters en masse, c'est un peu ennuyeux. Puis des retwitter de meme de droites. Puis des retwitters furieux de droite. Puis des retwitters acharnés dès qu'un tweet pouvait dire "bouh la gauche". C'est fatigant.

Autant on a eu des rafales de liens youtube de musiciens bizarre (perso j'aime pas, mais bon, on est dans de la découverte musicale, donc j'accepte les liens), autant les liens twitter qui sont qu'un ramassis continu de "gneugneugneugocho-woko-gocho-prout" ça devient lassant.

J'ai vu pas mal de communautés sur internet ou un couillon vient parcequ'il ya a une bonne ambiance, il pourrit le truc, et tout le monde finit par partir. Les commus qui tiennent, c'est souvent un bon modo et une sulfateuse à bannissement. Ce qu'il manque selon moi à la tribune, c'est une plonk list. Ca doit se faire avec un script greasemonkey, j'avais commencé à bricoler un truc qui marchait pas, je vais peut-être m'y remettre.

Et j'ai trouvé mon 10 : une assiette avec le couteau à côté

Ah bah non :-( Ca fait 01 du coup. On met le couteau à droite.

Mais en vrai, je trouve ça super intéressant comme concept. Pour apprendre les dates (ou codes, ou numéros de téléphone) j'utilisais le même genre de méthode. Dans mon ancien appart, le code était "64 51 32". Super facile à retenir: 64 est le double de 32, et il reste le 1 et le 5 pour faire 123456 et chaque paire est décroissante (et 64? bah si vous êtes informaticien, ce chiffre est forcément évident à se rappeler :D )

En ce moment je lis plein d'articles qui me disent que l'IA c'est le mal, que les LLM servent à rien, que c'est tout pourri, miroir aux alouettes, fausse bonne idée, etc etc etc… Les devs disent que l'IA les ralentit dans leur travail, que le code est plus long à corriger. Les littéraires disent que le texte est mauvais, les artistes disent que l'IA n'a aucune imagination, etc etc..

J'ai du mal à me défaire d'une idée. Autant lorsqu'une techno permet de créer des différenciateurs, les gens sont OK avec ça: par exemple, quand la bagnole arrive, on va avoir besoin de mécanos, de chauffeurs, etc.. quand internet arrive, on va avoir besoin d'informaticiens pour créer des technos, des protocoles, des applis, mais quand l'IA arrive, les cols blancs observent avec horreur que leurs métiers vont disparaitre très très vite.

Correcteur? Traducteur? bim, écrasé.

Programmeur? Même chose.

Admin sys? Badaboum.

Toutes les professions col blanc (comptable, administrateur, juriste, employé de paye, etc), remplacés directs.

Ceux qui se rendent compte de ce remplacement, ce sont les informaticiens, et sans surprise, ce sont les premiers à freiner en mode "nan nan, nous les informaticiens on est incontournables, et bien meilleurs que ces LLMs qui sont nuls, haha".

du coup, tous ces commentaires sur la faible qualité de l'IA seraient totalement hypocrites? (qui veut tuer son chien l'accuse de la rage). Et l'IA beaucoup plus performante (ou effrayante) que ce que laissent entendre ces posts de blogs.

Ah ui, c'est un vieeeeeeeux programme. Déjà qu'on rigole quand on voit que l'icone sauvegarder c'est une disquette (pour les plus jeunes d'entre nous, une disquette, c'est léquivalent d'une vieille clé USB), mais là, le seul icône qui est présenté, c'est celui de Netscape ("Netscape Navigator était un navigateur web qui a dominé le marché au milieu des années 1990." extrait de wikipedia)

C'est hors de portée de la plupart des gens, y compris toi vu que tu n'as pas pensé aux clés mentant se faisant passer pour un clavier, aux attaques sur le firmware usb,

ouais, c'est bien ce qui me ferait peur. La détection USB, c'est le kernel linux qui le fait. Si y'a un bug là dedans -> bimbamboum le méchant a accès a de l'exec code kernel, et c'est fini. Idem avec les filesystems. Tu fais un mount /dev/sdb1 /mnt et bimbamboum le kernel croit que c'ets un fs un peu exotique qui a des bugs, et once again, le méchant exécute du code en kernel.

Bootkitty relies on a self-signed certificate, so it won't execute on systems with Secure Boot enabled and only targets certain Ubuntu distributions.

Additionally, hardcoded offsets and simplistic byte-pattern matching make it only usable on specific GRUB and kernel versions, so it's unsuitable for widespread deployment.

ESET also notes that the malware contains many unused functions and handles kernel-version compatibility poorly, often leading to system crashes.

bootkit.efi contains many artifacts suggesting this is more like a proof of concept than the work of an active threat actor.

Whether a proof of concept or not, Bootkitty marks an interesting move forward in the UEFI threat landscape, breaking the belief about modern UEFI bootkits being Windows-exclusive threats. Even though the current version from VirusTotal does not, at the moment, represent a real threat to the majority of Linux systems, it emphasizes the necessity of being prepared for potential future threats.

Alors selon moi, c'est un gars qu'a dev à l'arrache un truc, et un vendeur de solution de sécurité est tombé par hasard dessus et s'est dit: "wolalala, on fait monter la sauce, on en parle comme étant le next big one, on va flex et on va se faire mousser et on va vendre nos outils comme des petits pains après ça, vazy gros, écrit un blogpost technique, c'est bon frérot, à nous les lambo les filles qui marchent dans la rue et la cocaine!!"

Bref. Tous les 6 mois on nous parle soit du malware delamorkitu qui va impacter tous les macOS du monde, soit du pirate trop fort qui va pirater tous les linux du monde, soit de la menace oulalala qu'elle est grave.

Je préfère lire le blogpost technique, garder la tête froide, et me resservir une bière.

test technique sans interlocuteur en présentiel ou en visio pendant le test = rédhibitoire

bah, je sais pas, ça me parait être une bonne illustration de ce que je vais faire par la suite. (le test c'était pas un fizzbuzz, hein, c'était de vrais bouts de codes à écrire/relire et des questions un peu plus ouvertes). Et l'entretien qui a suivi était intéressant, ça permet de poser des questions des deux côtés.

pour moi tout ce qui se fait lors d'un recrutement, est fait en temps réel avec le recruteur ; c'est un échange 1-1, il n'y a aucune raison que le recruteur se prenne des privilèges d'imposer des "devoirs à la maison" aux candidats pour éliminer ceux qui ne veulent pas s'investir "à 200%"

Je le prends pas comme ça. C'est pour un poste en remote, j'ai pas envie de prendre le train (le payer) et perdre une journée pour 2h d'entretien en début de processus. Le gars me file un devoir, il me dit "passe 2h dessus, pas plus de 4h".

Je vois un peu ce qui est demandé, s'il me faut 8h pour le faire, c'est déjà un signe, pareil s'il me faut 30mn. Là, fallait (entre autre) coder des trucs en java, d'où mon ami chatGPT. si ça avait été du fizzbuzz ou recoder un quicksort, j'aurai drop la candidature. La qualité de l'exercice demandé, ça va dans les deux sens :-)

un recrutement = des échanges, des vérifications de connaissances, compétences, par voie orale exclusivement, ou en présentiel dans l'entreprise.

je suis nul à l'oral, et un recruteur qui m'entend dire "bin euh, bin euh" ça va pas m'aider. Je file mon github, là, ça parle.

Je trouve que ça ne sert pas à grand chose aujourd'hui : toutes les réponses sont sur des forums techniques, ou maintenant disponibles auprès des IA. Je préfère demander à la personne comment elle s'y prendrait pour résoudre tel ou tel problème

Précisément. Savoir se servir d'une IA, ça pourrait passer comme une compétence super utile?

Si je félicite un candidat pour le code copier/coller qu'il m'a fourni ce sera bien entendu ironique et surtout dans l'espoir de provoquer une réaction de sa part.

Ce journal m'a fait penser à un truc. On connaît le temps actuel (suffit d'ouvrir la fenêtre), le temps futur (suffit d'ouvrir ce journal), mais comment connaître le temps passé? (suffit d'ouvrir sa mémoire, mais en fait non).

Le problème que j'ai des fois, c'est de connaitre le temps qu'il faisait hier (et avant hier) ailleurs. Je veux me balader en forêt (loin de chez moi), si les trois derniers jours il a plu, vaut mieux prendre mes bottes, et je n'ai pas forcément noté la météo depuis trois jours.

Je ne vois pas en quoi mettre du chewing-gum le port USB d'un téléphone relève de la bonne hygiène de vie.

Tu prends ça de manière un peu méprisante (chewing gum).

Si tu as besoin d'un équipement sécurisé, tu achètes un équipement sécurisé.

La je demande des liens vers des "équipements sécurisés".

Là c'est du niveau "truc et astuce de racaille pour éviter que les flics récupèrent dans la journée les contacts de ton point de deal".

ou bien mille autres raisons plus ou moins valides. Depuis "je veux pas que ma petite soeur lise mes sms" à "je suis journaliste qui veux protéger ses sources".

Autrement, on peut mettre "s'assurer que l'escalier de secours est à moins de 2m de la fenêtre de la chambre en cas de perquisition" dans les conseils de bonne hygiène de vie…

on conseille bien de mettre un détecteur de fumé, alors un escalier de secours en cas d'incendie, pourquoi pas

Si c'est de la délinquance courante (vol de téléphone dans les transports en commun ou lors d'un cambriolage), il est évident que l'attaquant n'a pas la moindre idée de quoi faire dès que tu as changé le moindre truc sur ton téléphone.

ou même, sans rien changer.

Si c'est du crime organisé, alors l'option séquestration + tabassage semble bien plus probable.

Ouais, pareil, je pense qu'ils prendront l'option "péter les genoux"

Si c'est des services secrets d'une puissance étrangère, tu devrais de toutes manières être dans une situation où tu as accès à du matériel bien plus sécurisé que les téléphones du commerce.

Je découperais en deux: il peut s'agir d'une puissance étatique quelconque (voir ton pays à toi). Et avoir du matos banalisé, c'est discret.

Et si c'est un labo de la police pour une enquête de justice, ça m'étonnerait que ça aille bien loin au-delà de "le port USB n'est pas accessible" vu les moyens de la justice

je pense que la justice a des moyens mais je peux me tromper

Reste quoi, l'espionnage industriel?

Pourquoi pas, mais le mode par défaut des téléphones est suffisant. Il est plus judicieux de corrompre quelqu'un je pense

Après on peut imaginer ça comme une construction de l'esprit. Je ne veux pas que quelqu'un ait accès à mes données. Mais je pense que c'est peine perdue. C'est d'ailleurs pour ça que je ne met que des trucs assez random sur mon téléphone. Un "grand méchant" saura que j'ai utilisé mon GPS pour aller à la pizzeria "il forno" et que je consulte mon solde bancaire sur le site web de la banque et que j'ai envoyé un SMS il y a deux jours (sms: 'T où?').

Arriver à dumper la RAM en AFU via le Bluetooth ou le NFC, ça me semble vraiment improbable. Ces connexions ne permettent pas d’avoir un accès assez bas niveau pour ça.

Pourquoi est tu focalisé sur le dump de RAM? Dans le cas hypothétique ou j'ai une vuln dans le NFC:

je prends ton tél, je prends le contrôle du NFC, puis j'ai une vuln kernel et je suis root avec le plus haut niveau de privilèges.

Je peux alors lire tes applis, keylog tes mots de passes, modifier ton disque, lire tes mails etc….

Pour les fake updates, les applis que j’utilise sont signées avec ma clé, donc elles ne s’installeront pas.

Ok. Et il n'y a pas de vulns dans le processus d'update ? Genre ton update d'app est signée, mais le code qui va dl l'update, il est fiable? Same shit, l'attaquant prend le contrôle du code qui fait l'update, puis il élève ses privilèges, et hop, dump disque, lecture de tes secrets, emails, keylogging, etc..

Idem pour l’OS, qui est un fork maison de GrapheneOS (GOS). Donc là-dessus, je suis couvert.

Tu veux dire que seul tu arrives à suivre l'intégralité des vulns et des patchs qui sont publiés? Et que le code que tu as ajouté est exempt de vulns? (vraie question premier degré hein).

Après, même sans port USB, il reste quand même un paquet d'attaque.

Tu as une antenne bluetooth. Qu'est ce qui empêche quelqu'un d'attaquer le BT? Pareil avec le wifi. Pareil avec le NFC. Si tu te connectes à un réseau quelconque, tu as 10000 applis qui vont se connecter. Certaines sont vulnérables (genre une fake update, ce genre de trucs). etc etc

J'ai l'impression que tu parles de la cold-boot attack. On redémarre sur un système qui va dumper toute la RAM et à l'intérieur du dump on cherche des données comme les clés de chiffrement du disque. On déchiffre le disque, on accède à tes données.

Sur tes points:

A)

Pour le port USB, pourquoi pas l'enlever, mais qu'est ce qui empêche un attaquant de s'en prendre directement au disque? Il peut démonter le téléphone, ressouder un port USB (why not) et lancer des attaques sur le TEE (https://connect.ed-diamond.com/MISC/misc-099/android-tee) pour aller chercher à extraire tes clés de chiffrement de disque.

B)

ces 18h c'est pour grapheneOS? Après, cf point A, même après 18h.

C)

je pense que c'est la pire des solutions. Ca se décape très bien l'epoxy.

Un ordinateur ne pourra jamais battre un humain au jeu d'échec!!

Le jour ou un ordinateur sera capable de battre le champion du monde, ce sera la fin de l'humanité les robots prendront le pouvoir.

Bon, ok, kasparov s'est fait battre par deepBlue, mais en vrai ça veut pas dire grand chose, hein. On peut surentrainer un ordinateur pour jouer aux échecs, ça veut pas dire qu'il est intelligent. Et puis regardez, le jeu de Go, ça, jamais au grand jamais un ordinateur battra le meilleur joueur du monde. La complexité algorithmique est insoluble, même avec des ordinateurs massivement superscalaires!!

Bon, ok alpha Zero a gagné, mais en vrai ça veut pas dire grand chose. On peut surentrainer un ordinateur pour jouer au Go, ça veut pas dire qu'il est intelligent. Et puis regardez, le langage naturel, ça, jamais au grand jamais un ordinateur sera capable de tenir une conversation naturelle avec un humain. La difficulté de comprendre toutes les nuances de langage est mathématiquement impossible et non modélisable.

Bon, ok chatGPT parle plutôt bien, mais en vrai ça veut pas dire grand chose. On peut surentrainer un ordinateur pour faire des phrases qui font du sens, mais ça veut pas dire qu'il est intelligent…

# Il reste la force brute

Posté par octane . En réponse au message Mot de passe de disque dur chiffré perdu.. Évalué à 3.

D'abord un lien assez bien fait:

https://diverto.github.io/2019/11/18/Cracking-LUKS-passphrases

Il donne pas mal de programmes, d'infos, de check à faire etc etc..

Là, il faut un autre programme qui va te générer un dictionnaire. John dispose d'un langage spécifique permettant de générer des candidats à partir de règle. Par exemple:

-Je pars d'un mot du dictionnaire

-Je remplace les o par des 0

-J'ajoute le suffix '555!!!' systématiquement

etc etc

John va être capable de te générer un dictionnaire basé sur ces règles. Hashcat à des options équivalentes. Une fois que tu as le dico, tu peux lancer le bruteforce avec l'outil le plus adapté. Ensuite, modifie subtilement ton dictionnaire, ajoute de la force brute, etc etc..

[^] # Re: Amusant !

Posté par octane . En réponse au journal [ HS ] Appel à contribution : "imaginer" des chiffres.. Évalué à 3.

Oui, je pense que j'ai surinterprété le message du posteur initial. Je pensais qu'il proposait le couteau et l'assiette à tout le monde pour faire 10. D'où problème, si on s'adresse à tous on a besoin d'un référentiel commun. Et pour la position du couteau on doit se baser du coup sur un référentiel pour partager l'image, et le seul référentiel possible qui est "les arts de la table" ne correspond pas à un 10. Mais à la relecture, je pense que le posteur originel ne parlait que de sa propre image mentale, et du coup, ça fonctionne (pour lui).

[^] # Re: Amusant !

Posté par octane . En réponse au journal [ HS ] Appel à contribution : "imaginer" des chiffres.. Évalué à 4. Dernière modification le 14 janvier 2025 à 11:35.

Les arts de la table semblent quand même imposer un ordonnancement assez précis dans le dressage:

Après, il n'y a aucune obligation :-)

Bon, j'ai cherché, et apparemment il n'y a rien pour les gauchers

[^] # Re: À quoi sert la tribune ?

Posté par octane . En réponse au journal Il y a quelque chose de pourri.... Évalué à 3.

Et que c'est un des derniers sites web sans pub envahissante, sans 10000 trackers, sans inscription avec un téléphone qui te permette de mouler tranquillement avec un pseudo. J'ai pu troller gentiment sans risquer que mon employeur tombe dessus, et ça, c'est essentiel.

[^] # Re: le problème

Posté par octane . En réponse au journal Il y a quelque chose de pourri.... Évalué à 10.

Je peux ptêt ajouter ma pierre à l'édifice. J'aim(ais)e bien la tribune, la twibioune, l'incubateur d'excellence. Ca trollait gentiment, ça posait des questions techniques de temps en temps, on avait un ancrage légèrement à gauche (youpi), et ça discutait. Puis bon, on a eu droit à des retwitters en masse, c'est un peu ennuyeux. Puis des retwitter de meme de droites. Puis des retwitters furieux de droite. Puis des retwitters acharnés dès qu'un tweet pouvait dire "bouh la gauche". C'est fatigant.

Autant on a eu des rafales de liens youtube de musiciens bizarre (perso j'aime pas, mais bon, on est dans de la découverte musicale, donc j'accepte les liens), autant les liens twitter qui sont qu'un ramassis continu de "gneugneugneugocho-woko-gocho-prout" ça devient lassant.

J'ai vu pas mal de communautés sur internet ou un couillon vient parcequ'il ya a une bonne ambiance, il pourrit le truc, et tout le monde finit par partir. Les commus qui tiennent, c'est souvent un bon modo et une sulfateuse à bannissement. Ce qu'il manque selon moi à la tribune, c'est une plonk list. Ca doit se faire avec un script greasemonkey, j'avais commencé à bricoler un truc qui marchait pas, je vais peut-être m'y remettre.

[^] # Re: Amusant !

Posté par octane . En réponse au journal [ HS ] Appel à contribution : "imaginer" des chiffres.. Évalué à 2.

Ah bah non :-( Ca fait 01 du coup. On met le couteau à droite.

Mais en vrai, je trouve ça super intéressant comme concept. Pour apprendre les dates (ou codes, ou numéros de téléphone) j'utilisais le même genre de méthode. Dans mon ancien appart, le code était "64 51 32". Super facile à retenir: 64 est le double de 32, et il reste le 1 et le 5 pour faire 123456 et chaque paire est décroissante (et 64? bah si vous êtes informaticien, ce chiffre est forcément évident à se rappeler :D )

# l'IA c'est le mal

Posté par octane . En réponse au lien When ChatGPT summarises, it actually does nothing of the kind.. Évalué à -3.

En ce moment je lis plein d'articles qui me disent que l'IA c'est le mal, que les LLM servent à rien, que c'est tout pourri, miroir aux alouettes, fausse bonne idée, etc etc etc… Les devs disent que l'IA les ralentit dans leur travail, que le code est plus long à corriger. Les littéraires disent que le texte est mauvais, les artistes disent que l'IA n'a aucune imagination, etc etc..

J'ai du mal à me défaire d'une idée. Autant lorsqu'une techno permet de créer des différenciateurs, les gens sont OK avec ça: par exemple, quand la bagnole arrive, on va avoir besoin de mécanos, de chauffeurs, etc.. quand internet arrive, on va avoir besoin d'informaticiens pour créer des technos, des protocoles, des applis, mais quand l'IA arrive, les cols blancs observent avec horreur que leurs métiers vont disparaitre très très vite.

Correcteur? Traducteur? bim, écrasé.

Programmeur? Même chose.

Admin sys? Badaboum.

Toutes les professions col blanc (comptable, administrateur, juriste, employé de paye, etc), remplacés directs.

Ceux qui se rendent compte de ce remplacement, ce sont les informaticiens, et sans surprise, ce sont les premiers à freiner en mode "nan nan, nous les informaticiens on est incontournables, et bien meilleurs que ces LLMs qui sont nuls, haha".

du coup, tous ces commentaires sur la faible qualité de l'IA seraient totalement hypocrites? (qui veut tuer son chien l'accuse de la rage). Et l'IA beaucoup plus performante (ou effrayante) que ce que laissent entendre ces posts de blogs.

[^] # Re: oh :-)

Posté par octane . En réponse au lien WindowMaker Live 12.8. Évalué à 4.

Ah ui, c'est un vieeeeeeeux programme. Déjà qu'on rigole quand on voit que l'icone sauvegarder c'est une disquette (pour les plus jeunes d'entre nous, une disquette, c'est léquivalent d'une vieille clé USB), mais là, le seul icône qui est présenté, c'est celui de Netscape ("Netscape Navigator était un navigateur web qui a dominé le marché au milieu des années 1990." extrait de wikipedia)

# oh :-)

Posté par octane . En réponse au lien WindowMaker Live 12.8. Évalué à 5. Dernière modification le 18 décembre 2024 à 11:37.

J'ai utilisé longtemps windowmaker, et il m'avait beaucoup plu.

Léger, configurable, j'avais un dock super pratique.

Je m'en vais tester de ce pas la version live

[^] # Re: la clé de la contamination ou de l’intrusion

Posté par octane . En réponse au journal Un câble USB qui permet de pirater un ordinateur.. Évalué à 2.

comme je suis très premier degré, je pense qu'il faut un plus qu'une nanoseconde pour exploiter un bug USB.

Après ça me fait penser à terminator (pas l'émulateur de terminal, le film avec Skynet).

Et la fin me fait rigoler, l'uptime dans ce genre de situations, c'est pas important :-D

[^] # Re: la clé de la contamination ou de l’intrusion

Posté par octane . En réponse au journal Un câble USB qui permet de pirater un ordinateur.. Évalué à 3.

ouais, c'est bien ce qui me ferait peur. La détection USB, c'est le kernel linux qui le fait. Si y'a un bug là dedans -> bimbamboum le méchant a accès a de l'exec code kernel, et c'est fini. Idem avec les filesystems. Tu fais un mount /dev/sdb1 /mnt et bimbamboum le kernel croit que c'ets un fs un peu exotique qui a des bugs, et once again, le méchant exécute du code en kernel.

# oui mais

Posté par octane . En réponse au lien Researchers discover first UEFI bootkit malware for Linux. Évalué à 8.

c'est vraiment un malware ce truc??

Bootkitty relies on a self-signed certificate, so it won't execute on systems with Secure Boot enabled and only targets certain Ubuntu distributions.

Additionally, hardcoded offsets and simplistic byte-pattern matching make it only usable on specific GRUB and kernel versions, so it's unsuitable for widespread deployment.

ESET also notes that the malware contains many unused functions and handles kernel-version compatibility poorly, often leading to system crashes.

et depuis https://www.welivesecurity.com/en/eset-research/bootkitty-analyzing-first-uefi-bootkit-linux/

bootkit.efi contains many artifacts suggesting this is more like a proof of concept than the work of an active threat actor.

Whether a proof of concept or not, Bootkitty marks an interesting move forward in the UEFI threat landscape, breaking the belief about modern UEFI bootkits being Windows-exclusive threats. Even though the current version from VirusTotal does not, at the moment, represent a real threat to the majority of Linux systems, it emphasizes the necessity of being prepared for potential future threats.

Alors selon moi, c'est un gars qu'a dev à l'arrache un truc, et un vendeur de solution de sécurité est tombé par hasard dessus et s'est dit: "wolalala, on fait monter la sauce, on en parle comme étant le next big one, on va flex et on va se faire mousser et on va vendre nos outils comme des petits pains après ça, vazy gros, écrit un blogpost technique, c'est bon frérot, à nous les lambo les filles qui marchent dans la rue et la cocaine!!"

Bref. Tous les 6 mois on nous parle soit du malware delamorkitu qui va impacter tous les macOS du monde, soit du pirate trop fort qui va pirater tous les linux du monde, soit de la menace oulalala qu'elle est grave.

Je préfère lire le blogpost technique, garder la tête froide, et me resservir une bière.

[^] # Re: Mon avis

Posté par octane . En réponse au message LLM et offres d'emploi. Évalué à 2.

il y a vraiment une frontière entre les deux?

[^] # Re: test technique

Posté par octane . En réponse au message LLM et offres d'emploi. Évalué à 3.

bah, je sais pas, ça me parait être une bonne illustration de ce que je vais faire par la suite. (le test c'était pas un fizzbuzz, hein, c'était de vrais bouts de codes à écrire/relire et des questions un peu plus ouvertes). Et l'entretien qui a suivi était intéressant, ça permet de poser des questions des deux côtés.

Je le prends pas comme ça. C'est pour un poste en remote, j'ai pas envie de prendre le train (le payer) et perdre une journée pour 2h d'entretien en début de processus. Le gars me file un devoir, il me dit "passe 2h dessus, pas plus de 4h".

Je vois un peu ce qui est demandé, s'il me faut 8h pour le faire, c'est déjà un signe, pareil s'il me faut 30mn. Là, fallait (entre autre) coder des trucs en java, d'où mon ami chatGPT. si ça avait été du fizzbuzz ou recoder un quicksort, j'aurai drop la candidature. La qualité de l'exercice demandé, ça va dans les deux sens :-)

je suis nul à l'oral, et un recruteur qui m'entend dire "bin euh, bin euh" ça va pas m'aider. Je file mon github, là, ça parle.

La vidéo de motivation -> poubelle.

[^] # Re: Entrtien techniques

Posté par octane . En réponse au message LLM et offres d'emploi. Évalué à 3.

Précisément. Savoir se servir d'une IA, ça pourrait passer comme une compétence super utile?

[^] # Re: Circonspection

Posté par octane . En réponse au message LLM et offres d'emploi. Évalué à 4.

bon, ok :-(

# je hijack le commentaire

Posté par octane . En réponse au journal Demerdification de prévisions météo avec Puppeteer. Évalué à 9.

Ce journal m'a fait penser à un truc. On connaît le temps actuel (suffit d'ouvrir la fenêtre), le temps futur (suffit d'ouvrir ce journal), mais comment connaître le temps passé? (suffit d'ouvrir sa mémoire, mais en fait non).

Le problème que j'ai des fois, c'est de connaitre le temps qu'il faisait hier (et avant hier) ailleurs. Je veux me balader en forêt (loin de chez moi), si les trois derniers jours il a plu, vaut mieux prendre mes bottes, et je n'ai pas forcément noté la météo depuis trois jours.

Ca existe des sites météo qui ont un historique?

[^] # Re: Tu ne serais pas un eco-térrosite en herbe, des fois ?

Posté par octane . En réponse au journal Sécurisation du port USB-C sur smartphone pour moules barbares. Évalué à 6.

Tu prends ça de manière un peu méprisante (chewing gum).

La je demande des liens vers des "équipements sécurisés".

ou bien mille autres raisons plus ou moins valides. Depuis "je veux pas que ma petite soeur lise mes sms" à "je suis journaliste qui veux protéger ses sources".

on conseille bien de mettre un détecteur de fumé, alors un escalier de secours en cas d'incendie, pourquoi pas

[^] # Re: La réponse D

Posté par octane . En réponse au journal Sécurisation du port USB-C sur smartphone pour moules barbares. Évalué à 3.

ou même, sans rien changer.

Ouais, pareil, je pense qu'ils prendront l'option "péter les genoux"

Je découperais en deux: il peut s'agir d'une puissance étatique quelconque (voir ton pays à toi). Et avoir du matos banalisé, c'est discret.

je pense que la justice a des moyens mais je peux me tromper

Pourquoi pas, mais le mode par défaut des téléphones est suffisant. Il est plus judicieux de corrompre quelqu'un je pense

Après on peut imaginer ça comme une construction de l'esprit. Je ne veux pas que quelqu'un ait accès à mes données. Mais je pense que c'est peine perdue. C'est d'ailleurs pour ça que je ne met que des trucs assez random sur mon téléphone. Un "grand méchant" saura que j'ai utilisé mon GPS pour aller à la pizzeria "il forno" et que je consulte mon solde bancaire sur le site web de la banque et que j'ai envoyé un SMS il y a deux jours (sms: 'T où?').

[^] # Re: pourquoi la ram uniquement?

Posté par octane . En réponse au journal Sécurisation du port USB-C sur smartphone pour moules barbares. Évalué à 5.

Pourquoi est tu focalisé sur le dump de RAM? Dans le cas hypothétique ou j'ai une vuln dans le NFC:

je prends ton tél, je prends le contrôle du NFC, puis j'ai une vuln kernel et je suis root avec le plus haut niveau de privilèges.

Je peux alors lire tes applis, keylog tes mots de passes, modifier ton disque, lire tes mails etc….

Ok. Et il n'y a pas de vulns dans le processus d'update ? Genre ton update d'app est signée, mais le code qui va dl l'update, il est fiable? Same shit, l'attaquant prend le contrôle du code qui fait l'update, puis il élève ses privilèges, et hop, dump disque, lecture de tes secrets, emails, keylogging, etc..

Tu veux dire que seul tu arrives à suivre l'intégralité des vulns et des patchs qui sont publiés? Et que le code que tu as ajouté est exempt de vulns? (vraie question premier degré hein).

[^] # Re: pourquoi la ram uniquement?

Posté par octane . En réponse au journal Sécurisation du port USB-C sur smartphone pour moules barbares. Évalué à 2.

Après, même sans port USB, il reste quand même un paquet d'attaque.

Tu as une antenne bluetooth. Qu'est ce qui empêche quelqu'un d'attaquer le BT? Pareil avec le wifi. Pareil avec le NFC. Si tu te connectes à un réseau quelconque, tu as 10000 applis qui vont se connecter. Certaines sont vulnérables (genre une fake update, ce genre de trucs). etc etc

# pourquoi la ram uniquement?

Posté par octane . En réponse au journal Sécurisation du port USB-C sur smartphone pour moules barbares. Évalué à 4.

J'ai l'impression que tu parles de la cold-boot attack. On redémarre sur un système qui va dumper toute la RAM et à l'intérieur du dump on cherche des données comme les clés de chiffrement du disque. On déchiffre le disque, on accède à tes données.

Sur tes points:

A)

Pour le port USB, pourquoi pas l'enlever, mais qu'est ce qui empêche un attaquant de s'en prendre directement au disque? Il peut démonter le téléphone, ressouder un port USB (why not) et lancer des attaques sur le TEE (https://connect.ed-diamond.com/MISC/misc-099/android-tee) pour aller chercher à extraire tes clés de chiffrement de disque.

B)

ces 18h c'est pour grapheneOS? Après, cf point A, même après 18h.

C)

je pense que c'est la pire des solutions. Ca se décape très bien l'epoxy.

[^] # Re: un ordinateur ne pourra jamais battre un champion d'échec!

Posté par octane . En réponse au lien Team claims human-level AI is impossible — ever. Évalué à 2.

Non, c'est moi qui suis idiot ☹️

Je m'exprime mal et je m'en excuse

# un ordinateur ne pourra jamais battre un champion d'échec!

Posté par octane . En réponse au lien Team claims human-level AI is impossible — ever. Évalué à 7.

Un ordinateur ne pourra jamais battre un humain au jeu d'échec!!

Le jour ou un ordinateur sera capable de battre le champion du monde, ce sera la fin de l'humanité les robots prendront le pouvoir.

Bon, ok, kasparov s'est fait battre par deepBlue, mais en vrai ça veut pas dire grand chose, hein. On peut surentrainer un ordinateur pour jouer aux échecs, ça veut pas dire qu'il est intelligent. Et puis regardez, le jeu de Go, ça, jamais au grand jamais un ordinateur battra le meilleur joueur du monde. La complexité algorithmique est insoluble, même avec des ordinateurs massivement superscalaires!!

Bon, ok alpha Zero a gagné, mais en vrai ça veut pas dire grand chose. On peut surentrainer un ordinateur pour jouer au Go, ça veut pas dire qu'il est intelligent. Et puis regardez, le langage naturel, ça, jamais au grand jamais un ordinateur sera capable de tenir une conversation naturelle avec un humain. La difficulté de comprendre toutes les nuances de langage est mathématiquement impossible et non modélisable.

Bon, ok chatGPT parle plutôt bien, mais en vrai ça veut pas dire grand chose. On peut surentrainer un ordinateur pour faire des phrases qui font du sens, mais ça veut pas dire qu'il est intelligent…

Je continue, ou vous avez compris l'idée?

[^] # Re: Infos à vérifier

Posté par octane . En réponse au journal Faille d'exécution de code à distance dans cups. Évalué à 4.

C'est exactement ce que je dis (?)

je comprends pas trop la remarque.