Pour qui s’intéresse au jeu vidéo, il y a quelques menus détails qui ont changé ces dernières années.

On ne va pas parler du prix des composants — GPU et RAM notamment — qui a littéralement flambé avec l’avènement de l’IA, devenant une véritable valeur refuge au même titre que l’or ou le palladium ; non, on va s’intéresser à la partie technique des jeux (ou du moins de leurs moteurs de rendu).

Sommaire

- Raytracing / Path tracing

- DLSS, FSR, XeSS, Reflex, Anti-Lag

- DLSS 5

- Implémentation par moteurs

- Impact sur les performances

- Impact sur le développement

- De nouveaux venus (Moore Threads, Lisuan Technology)

- Et les performances dans tout ça

Raytracing / Path tracing

Il doit être difficile en 2026 de ne pas avoir entendu les termes Raytracing et Path tracing. Mais concrètement, qu’est-ce que c’est et en quoi cela affecte les jeux vidéos ?

Pour en parler, il faut déjà revenir aux fondamentaux, c’est-à-dire la Rastérisation.

En modélisation 3D on a besoin d’afficher en deux dimensions (nos écrans) des objets en 3 dimensions. Étant loin d’être un expert de ces sujets, je dirais au doigt mouillé que ça doit remonter aux premiers rendus 3D.

Dans le contexte de la rastérisation, les objets à l’écran sont créés à partir d’un maillage virtuel de triangle ou de polygones (un mesh). Les coins de nos triangles sont appelés des vertices, et contiennent un paquet d’informations, comme leur position dans l’espace, ou bien leur couleur ou encore des données dite de « normale » qui permettent de déterminer la façon dont les faces d’un objet se présentent.

L’ordinateur convertit ensuite les triangles et les données des vertex en pixels affichés en 2D.

C’est la base de la rastérisation, on peut ensuite chaîner d’autres modifications sur nos pixels (des shaders : des programmes spécialisés qui fonctionnent en parallèles sur un GPU) pour modifier le rendu. C’est à cette étape que l’on fera de la magie noire pour simuler des effets de lumière, de réfraction, de réflexion, d’occlusion et j’en passe.

Pour les ombres il y a différentes techniques, la plus commune est la carte d’ombrage, qui permet de pré-calculer ou de calculer en temps réel ce qui est dans l’ombre (et doit donc être assombri) et ce qui ne l’est pas. Mais ces ombres sont dites « dures », pour des ombres diffuses (dites « soft ») il faut procéder un peu autrement.

On s’en sort en pratique fort bien, et d’autres techniques viennent compléter le tableau comme :

- les lightmaps,

- l’occlusion ambiante (SSAO, GTAO, etc.),

- les sondes de réflexions,

- les réflexions planaires qui — bien que gourmandes — donnent des réflexions claires comme le cristal en rendant la scène deux fois,

- le SSR qui tente de reconstruire des réflexions à partir des informations déjà affichées,

- les systèmes d’illuminations globales (SDFGI, Lumen)

- les systèmes d’antialiasing

- et une véritable myriade de joyeusetés toutes plus complexes et délicates les unes que les autres.

Source : OpenMW

Avec pour chaque technique des limites et inconvénients avec lesquels le développeur devra composer pour atteindre son objectif.

Ces liens donnent des informations pertinentes et compréhensible sur ces sujets :

- La documentation de Godot sur l’illumination globale (sondes de réflexion)

- La documentation de Godot sur les effets de rendu

- La documentation de Godot sur l’anticrénelage

- Un article de PC Gamer sur l’occlusion ambiante

- The state-of-art of Dynamic Global Illumination in video-games (En)

Aussi, ce journal de small_duck est particulièrement intéressant et facile à lire, en plus de présenter l’évolution des techniques de rendue antérieures à la rastérisation.

Et ce sera fait pour chaque pixel de l’écran. Pour un rendu en 4K on a 8 millions de pixels, et on cible de 30 à 90 images par seconde en moyenne. Mais les GPU modernes sont très forts à ce jeu-là.

Bon très bien, et le raytracing me direz-vous ? Attention à ne pas confondre avec le Raycasting, dont nous parlait jtremesay dans son journal en 2022.

On l’a vu avec la rastérisation, on procède de la manière qui nous a parue la plus efficace avec les moyens donnés. Mais si on visait des rendus plus réalistes, et par réaliste j’entends physiquement réaliste, il y a d’autres approches.

Dans le domaine de l’illumination globale citée plus haut, le raytracing (« lancer de rayon »), permet de remplacer quantité d’effets simulés par les autres techniques et ce avec une qualité et une fidélité supérieure. Le ray tracing est conçu dans les années 60 par Robert Goldstein, Roger Nagel de MAGi et Arthur Appel d’IBM.

Turner Whitted introduit le raytracing récursif dans un papier en 1980. Il décrit comment l’information de rendu est stockée dans un arbre, se propageant vers les surfaces puis vers les sources lumineuses, permettant de simuler fidèlement réflexions, ombres et réfractions.

Cette technique de rendu procède différemment de la rastérisation. Il faut imaginer que depuis chaque pixel de l’écran, un rayon va être envoyé dans le monde 3D, et quand ce rayon va toucher une surface, on va récupérer sa couleur. On pourra ensuite en fonction des données de la surface, lancer d’autres rayons, qui iront toucher d’autres surface et ainsi affiner la couleur de notre pixel.

C’est très similaire dans l’idée à l’ancienne théorie de la vision émissive.

Source : Path tracing sur Wikipedia

De ce fait, on calcule par un seul moyen, non seulement les couleurs des surfaces, mais aussi leur émission, leurs réflexions, leur ombrage et ce en tenant compte d’objets en dehors de l’espace visible à l’écran. C’est un moyen extrêmement puissant de rendre un monde en 3D, et ce n’est ainsi pas pour rien qu’il est utilisé pour le rendu des films d’animation par Pixar et Dreamworks dès les années 80 (avec une approche hybride) et plus généralement dans les années 2000.

Car il faut dire, et je pense qu’on peut s’en douter, que le raytracing est horriblement peu performant. Le lancer de rayon à lui seul est un goulot d’étranglement monstrueux.

Mais pourquoi s’arrêter en si bon chemin ? Le Path tracing, introduit par James Kajiya en 1986, plus moderne, est une forme de raytracing. À chaque rebond, au lieu de lancer plusieurs rayons déterministes, on tire une seule direction aléatoire selon une distribution statistique. Cela permet de simuler fidèlement la lumière indirecte, les caustiques, les surfaces translucides, au prix d’un bruit important.

D’apparence moins performante et complexe, cette méthode permet toutefois un résultat plus granulaire, en changeant le nombre de rayons initiaux. Le pathtracing doit accumuler suffisamment d’échantillons aléatoires pour que la moyenne converge vers une image propre. Avec peu d’échantillons, l’image est bruitée. Pour réduire ce bruit il faut soit plus d’échantillons (plus lent), soit un bon débruiteur.

Certaines parties d’une scène comme les miroirs ou les surfaces en verre nécessiteront plus de rayons pour rester cohérentes, se rapprochant de la version raytracing plus classique.

Source: nVidia

Dans le domaine du jeu vidéo, il a ainsi fallu attendre jusqu’à récemment pour que cette technique devienne viable pour du rendu temps réel. C’est nVidia qui a ouvert le bal en 2018 avec une conférence pour le lancement de leurs cartes RTX. AMD suivra avec les RX6000 et surprenamment, Intel avec les Arc.

Cette démo de THREE.js tourne dans le navigateur et affiche une boite de Cornell avec du Path Tracing.

Ces nouvelles cartes utilisent des unités matérielles dédiées au lancer de rayon, opération autrefois purement logicielle. Mais ça ne suffit pas à atteindre la vitesse suffisante pour une expérience fluide.

Ces cartes embarquent donc également une autre technologie, au moins aussi importante que le raytracing. Le DLSS.

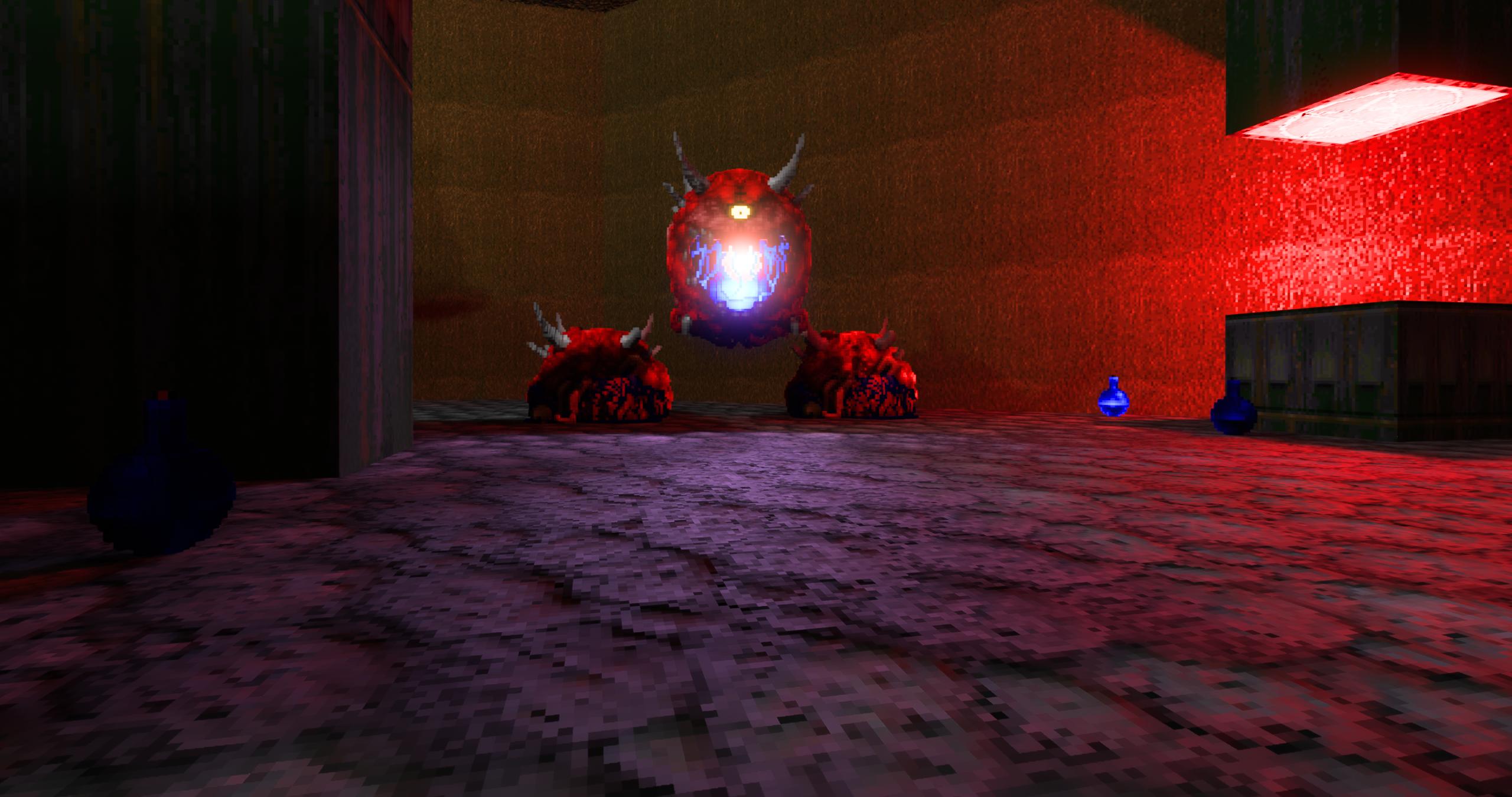

Histoire de se faire une idée rapidement, ce mod de DOOM 2 supporte le raytracing et ça change vraiment, avec un rendu atmosphérique !

Source : Le mod Doom 2: RAY TRACED sur moddb par shirokii

DLSS, FSR, XeSS, Reflex, Anti-Lag

nVidia présente donc en février 2019 le Deep Learning Super Sampling (DLSS) ou Super Échantillonnage en Apprentissage Profond. C’est une technologie de redimensionnement visant à produire une image plus grande à partir de la sortie du pipeline graphique.

Le défi étant de fabriquer ou de retrouver des détails à partir de pas grand-chose. Le DLSS utilise un réseau de neurones pour produire un résultat plutôt convaincant, surtout à mesure que les versions du DLSS se sont enchaînées. À tel point que le DLSS affiche parfois un meilleur rendu que le rendu natif.

En effet, si le but premier du DLSS et des autres technologies concurrentes est de réduire la résolution de rendu pour gagner en performance, le traitement du réseau de neurones peut être si bon qu’il parvient à reconstituer des détails plus fins que ce que produit le rendu natif.

Pour cela, il se base sur les images affichées, mais également sur des données fournies par le moteur, comme le vecteur de mouvement de l’image.

Il permet également de produire un rendu qui a virtuellement une résolution supérieure au natif qui est ensuite réduit à la résolution native. À la manière d’un Oversampling, mais sans le surcoût occasionné par le fait de rendre en 2 ou 4 fois plus grand.

Le DLSS est une technologie propriété de nVidia, qui utilise (sauf pour les premières versions) des éléments matériels pour fonctionner, des accélérateurs d’IA dédiés appelés Tensor Cores.

Les cœurs Tensor et autres accélérateurs IA peuvent entre autre utiliser des données de type FP16, INT8, INT4 et INT1, retenez-les bien, ça sera important.

Il n’a pas fallu longtemps avant qu’AMD ne se lance également sur le sujet avec son FidelityFX Super Resolution. Avec une approche différente, leurs cartes Radeon n’embarquant pas d’unités dédiées contrairement aux RTX de nVidia.

La première version du FSR est plus proche d’un shader d’upscalling comme ceux utilisés dans l’émulation retro que de ce que fait le DLSS.

Mais il a le mérite d’exister et de s’exécuter sur pratiquement n’importe quoi. Il a aussi le bon goût d’être libre. Il faudra attendre la version 2 pour voir quelque chose de plus intéressant, toujours agnostique du matériel utilisé et libre, et utilisant cette fois les vecteurs de mouvement également.

Cette fois-ci, si on est pas à la hauteur du DLSS on a quand même un gain de qualité par rapport à une résolution inférieure. Aux prix d’une image plus instable. Le FSR 3 (toujours libre et agnostique) améliorera un peu cette situation, mais sans régler tous les problèmes.

Sources : Notebook Check et Digital Foundry

Mais, car il y a un mais. Mais, donc, ces technologies ont un coût. En effet, même en faisant le rendu à une résolution plus faible que le natif et donc plus rapidement, il n’en reste pas moins que la mise à l’échelle prend du temps. Accélérateurs dédiés ou non. Dans un cas où on essayait de ramener des performances perdues lors de l’activation du Raytracing, on se retrouve à augmenter la latence.

Mais, car il y a de nouveau un mais, à chaque nouveau problème technologique, une solution (technologique elle aussi) existe ! nVidia se fend alors de la technologie Reflex, là ou AMD saupoudre son Anti-Lag et distille son Anti-Lag +. Ces solutions logicielles, propriétaires, fonctionnent uniquement sous Windows et à peu près de la même manière. Apparemment de base, le CPU peut préparer plus d’images que le GPU ne peut en afficher, remplissant alors un tampon ou une liste d’attente de rendu.

Plus il y a d’images dans la liste, plus la latence augmente, l’idée est donc de mieux synchroniser le rendu CPU et GPU, pour minimiser la taille de cette liste et donc la latence.

Suffisant ? Je ne sais pas.

Dans le même temps, Intel, qui se tâtait à se relancer sur le marché des GPU dédiés, se fend d’une première gamme de cartes graphiques, les Arc. Les cartes sont en dessous matériellement et logiciellement par rapport à leurs concurrentes, mais parviennent tout de même à faire tourner la plupart des jeux du moment. Si les pilotes ont des soucis de jeunesse, la prise en charge de Linux est de base très bonne et libre.

De manière générale, ces dernières années, le pilote libre des cartes Intel et AMD sous Linux est très bon et celui de nVidia s’améliore et s’ouvre un peu plus très peu mais reste basé sur un socle qui bien que performant est propriétaire.

Bref, Intel à la sortie de ses premières cartes (depuis un bail) les lance avec la gestion du raytracing et un équivalent aux DLSS et FSR : le XeSS. Il est plus proche du DLSS que du FSR, mais est agnostique du matériel comme le FSR. Il n’utilise d’accélérateur IA que sur les cartes Arc (cœur XMX), sur les autres il bascule sur les instructions DP4a pour exécuter son réseau de neurones. Il est souvent meilleur que le FSR en termes de stabilité, parfois pire. Si un SDK est disponible, il n’expose que des bibliothèques compilées. Le code reste donc fermé.

En parallèle de tout ça, arrive la génération d’image.

Maintenant, en plus d’augmenter la taille d’une « vraie » image générée virtuellement à l’ancienne, on va intercaler 1, 2, voir 3 images interpolées. Générées soit de façon analytique, soit via un réseau de neurones. C’est vendu sous le nom de Frame Generation par nVidia et AMD.

Côté AMD, il faut attendre le FSR 4 pour voir une utilisation d’un réseau de neurones.

Sources : Notebook Check et Digital Foundry

Le FSR fournit alors de bons résultats, et s’il reste légèrement moins qualitatif que le DLSS 4, il représente un saut appréciable par rapport au FSR 3. AMD ferme cette technologie aux cartes RX9000 en RDNA4, évoquant lui aussi l’usage d’instructions dédiées (FP8). Le code source n’est pas officiellement disponible, mais suite à une erreur de publication, le code d’une version du FSR 4 est publié en août 2025.

C’est plutôt ballot et cocasse pour AMD, car en plus de ne pas être voulu, cette version libérée comporte une implémentation fonctionnant sur INT8 du FSR 4. Or, nul besoin de la dernière génération de carte AMD pour les avoir. Ce qui veut dire, et les joueurs vont vite le démontrer en compilant eux-mêmes leur version, qu’il fonctionne en fait sur les cartes d’anciennes générations. Les cartes RDNA2 par exemple, plus vieilles de deux générations que les RX9000 en RDNA4, l’exécutent sans problème. Les cartes RTX 30 de nVidia également. Et si le gain en performance est inférieur aux cartes plus récentes, il reste présent et la qualité — surtout — augmente.

On peut d’ailleurs se demander si cette version du FSR 4 n’est pas la base technique du PSSR de Sony, développé par AMD à destination de la Playstation 5 qui embarque une architecture proche des cartes RDNA2 (elle est hybride). AMD est de son côté resté très silencieux sur le sujet.

On peut imaginer une décision court-termiste pour tenter de gonfler les ventes de la génération 9000, l’avenir dira si c’est un pari payant ou si les joueurs perçoivent cela comme une grossière insulte.

Il en reste la sensation d’un rendez-vous manqué, où le FSR4 aurait pu devenir de fait la méthode de mise à l’échelle universelle, car libre et indépendante de l’architecture. Mais sans qu’on sache exactement pourquoi, elle restera propriétaire et fermée à une gamme de carte.

Bref, à l’heure actuelle, seul les FSR 1, 2 et 3 sont libres et intégrables dans les moteurs de rendu libres comme Godot. Le DLSS et le XeSS restent utilisables pour qui en a la volonté. Le projet J.E.N.O.V.A qui permet notamment de coder en C++ sans passer par les GDExtenssions, utilise le DLSS par-dessus Godot et implémente le raytracing via le kit RTX de nVidia, mais cette portion est propriétaire pour le moment.

Ah ! Et bien entendu, à l’exception des FSR 1, 2 et 3, toutes ces technologies ne gèrent que DirectX. Sous Linux il faut donc passer par Wine / Proton / DXVK pour les exécuter.

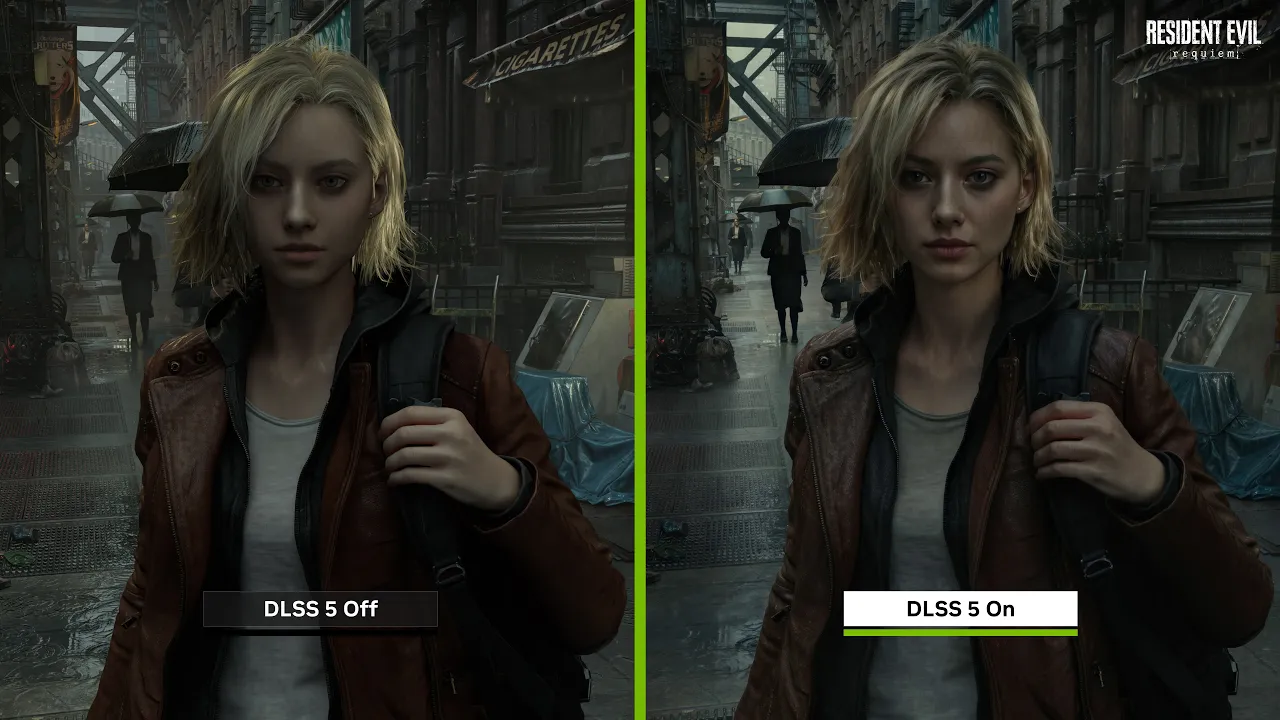

DLSS 5

Annoncé en 2026, le DLSS 5 n’est pas une itération du DLSS au sens classique du terme, ce n’est ni de l’upscaling ni de la génération d’image. Le DLSS 5 prend en entrée la couleur et les vecteurs de mouvement d’une image, et utilise un modèle d’IA pour y injecter un éclairage et des matériaux photoréalistes, de façon déterministe et stable temporellement d’après nVidia.

Le système est a l’état de preuve de concept, nécessitant deux RTX 5090 : l’une pour jouer, l’autre exclusivement pour faire tourner le DLSS 5. L’utilisation d’une seule carte reste l’objectif pour la sortie prévue à l’automne 2026. On bascule d’une amélioration de rendu, à une génération de rendu. Ce changement de paradigme est loin de faire l’unanimité. Si l’image que vous voyez est en grande partie inventée par un réseau de neurones, s’agit-il encore du jeu que les artistes ont conçu ?

Dira-t-on bientôt à un assistant dans Unreal : « Voilà mon niveau de test fait de boîtes simples, transforme-le en cathédrale. » ? Cela mènera-t-il à une uniformisation des graphismes ? À une crise pour les artistes 3D ?

Source : nVidia

Tout est possible. Il est également possible que les joueurs ne veuillent pas de cette technologie. Mais si actuellement les rendus peuvent se trouver dans la vallée dérangeante, il y a fort à parier que ça va rapidement devenir indiscernable d’un rendu classique de très haute qualité. Une fois la boîte ouverte, difficile de la refermer.

Reste le problème de confier la direction artistique à une machine, et le fait que cette technologie est encore une fois propriétaire.

Et ça c’est un problème plus important qu’on ne le penserait, car il concerne en fait plus d’utilisateurs que les libristes convaincus. En effet, si nVidia avec son DLSS 5 altère à ce point le rendu des jeux avec un réseau de neurones, il y a fort à parier qu’AMD et Intel vont suivre.

Mais pas avec le même modèle, pas avec la même technique. Et donc produiront un résultat différent. On peut donc craindre que selon la carte de l’utilisateur, le rendu soit variable.

La méthode enjolive l’image à un tel point qu’on peut également imaginer se passer de toute autre technique d’illumination pour revenir à de la pure rastérisation. Le raytracing étant alors relégué aux oubliettes des méthodes de rendu. Beaucoup de questions et peu de réponse, on verra bien.

Après cette première présentation du DLSS 5 qui a laissé les joueurs assez mitigés, nVidia a tenu à montrer d’autres usages du rendu neural, avec une présentation au GDC 2026 faisant la démonstration du NTC (Neural Texture Compression). Un système de compression de texture basé sur un réseau de neurone.

Implémentation par moteurs

L’intégration des technologies d’upscaling et de rendu avancé dans un moteur est une tâche qui peut être complexe.

Sur les moteurs propriétaires, Unreal Engine 5 intègre nativement le raytracing, le DLSS, le FSR et le XeSS. Epic a les moyens pour maintenir ces intégrations à jour et a un soutien de nVidia, AMD et Intel.

Unity les gère également. Ne les utilisant pas je ne saurais en parler avec pertinence, ça a l’air de très bien fonctionner. Il est intéressant de noter qu'Intel ne publie plus son plugin Xess pour Unity, pendant que le DLSS est implémenté au travers du High Definition Render Pipeline

Pour les moteurs libres comme Godot, la situation est différente.

Le raytracing n’était pas forcément une technologie très pertinente ni très facile à implémenter pour des jeux indépendants il y a quelques années. Il n’y a donc pas eu de vrai volonté de l’implémenter, d’autant que d’autres techniques plus classiques existent et fonctionnent sur toutes les cartes, permettant un rendu très qualitatif.

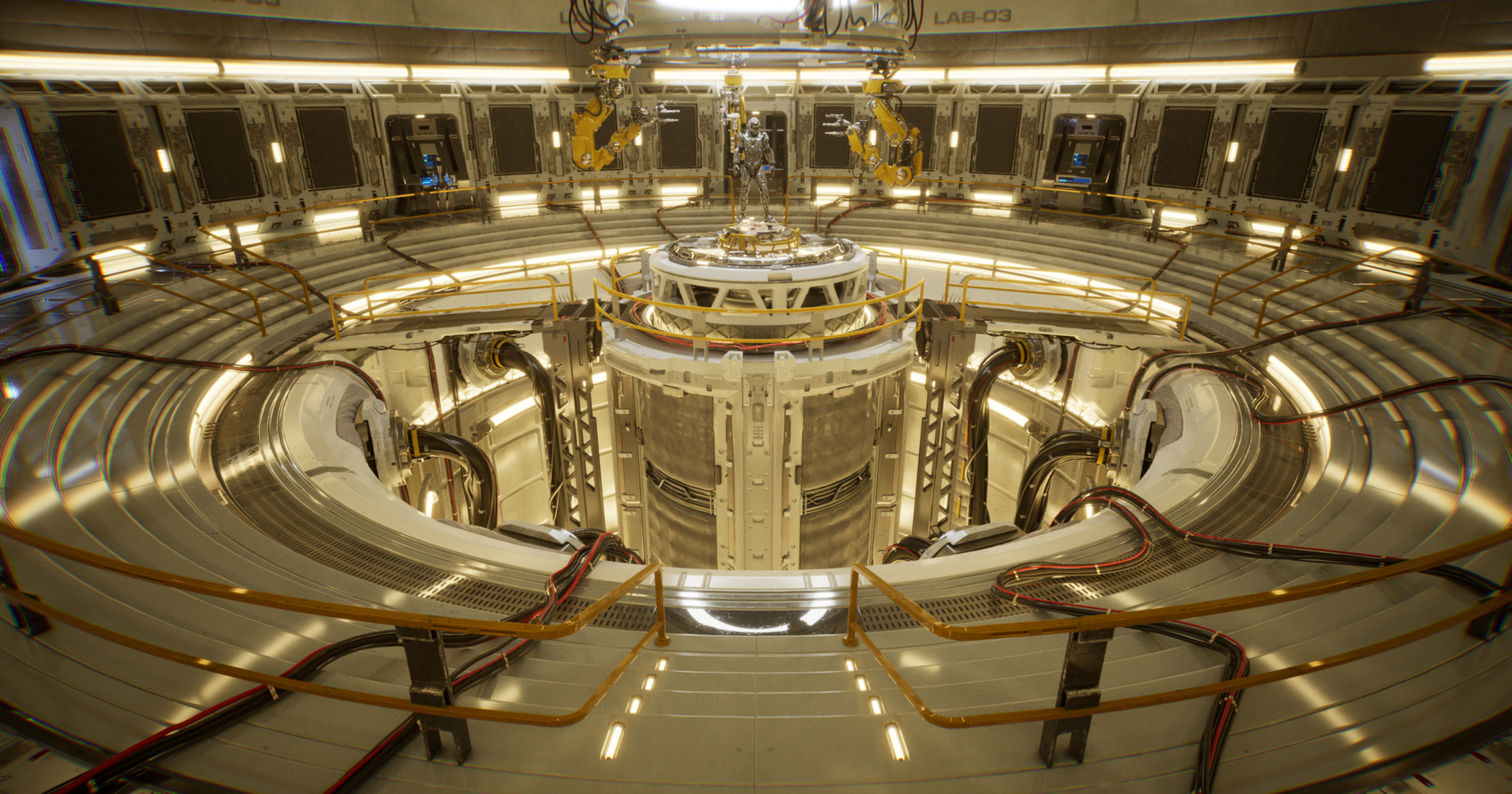

Mais cette situation qui est restée au point mort pendant quelques années a changé assez rapidement, avec une PR pour « mettre en place la plomberie nécessaire au raytracing ». Elle a été intégrée début 2026 dans la version 4.7, et dans la foulée nVidia a publié un fork de Godot supportant le pathtracing et le DLSS. Cette expérimentation ne prend en charge actuellement que les cartes nVidia, mais se base sur la PR mentionnée plus haut, et devrait à terme permettre un pathtracing agnostique de la carte utilisée.

À voir cependant si elle sera intégrable en l’état, ayant été codée avec l’aide de Claude et de Cursor. Elle permet en tout cas de montrer ce qui est actuellement possible en utilisant les briques bas niveaux de Godot, et permet d’espérer voir le tracé de rayon officiellement utilisable avec le moteur dans un avenir proche. Pour rester indépendant d’un vendeur de carte, il faudra aussi intégrer un débruiteur en remplacement de celui utilisé, spécifique à nVidia. Cette vidéo de Leroy Sikkes de chez nVidia au GDC 2026 présente toute la méthodologie du projet.

Le FSR 3 (le dernier à être resté libre et agnostique) est intégrable, mais actuellement seul le FSR2 est disponible sans compiler une PR. Le DLSS et le XeSS le sont aussi techniquement, via des greffons communautaires ou officiels, mais requièrent une acceptation de licences propriétaires. Ils ne seront certainement jamais intégrés directement dans le moteur, pas sans changement de licence. Le FSR 4 tombe dans la même catégorie pour le moment du fait de l’incertitude sur sa licence, même si l’implémentation publiée par erreur par AMD était utilisable, elle concerne DirectX, et non Vulkan, et ne pourrait être exécutable que sous Windows (ou éventuellement via Wine/Proton/DXVK).

Si on regarde du côté de Bevy, des contributeurs ont proposé des implémentations du DLSS, du FSR et même un début d’implémentation du raytracing avec Solari. Les articles rédigés par l’auteur de Solari sont d’ailleurs fabuleux.

Au-delà de tout ça, dans le but de réduire l’impact sur les performances et de produire un meilleur résultat, les technologies de raytracing se voient souvent complétées par des dé-bruiteurs et une pelletée de technologies propriétaires assistées par IA.

Source : Dépôt NRD

L’image brute d’un rendu par lancer de rayon est un champ de points colorés aléatoires. Pour en faire une image propre, il faut la débruiter, et c’est là que l’écosystème de technologies se remet à foisonner.

On peut les classer en deux familles : les débruiteurs analytiques (qui utilisent des algorithmes et du filtrage) et les débruiteurs neuraux (qui utilisent des réseaux de neurones entraînés sur des données de rendu). Les premiers ne nécessitent généralement par une carte particulière alors que les seconds ne sont compatibles qu’avec certaines gammes de cartes.

L’écosystème construit par nVidia est le plus propriétaire de tous, mais c’est de loin le plus complet et le plus documenté. C’est le RTX Kit, il propose le NRD — NVIDIA Real-time Denoiser, un débruiteur analytique qui fonctionne par accumulation temporelle de pixels sur plusieurs frames, et interpolation spatiale entre pixels voisins. Le NRD (une fois n’est pas coutume) est disponible en source ouverte, agnostique de l’API (DX12 et Vulkan), et peut donc être intégré dans n’importe quel moteur.

nVidia fournit également le Ray Reconstruction, un débruiteur neural. Il reconnaît les différents types d’effets raytracing pour prendre de meilleures décisions sur l’utilisation des données temporelles et spatiales, et conserve des informations haute fréquence que les débruiteurs classiques ont tendance à lisser.

Enfin le NRC (Neural Radiance Cache) utilise des réseaux de neurones pour estimer la lumière indirecte avec plus de précision. Extrapolant un éclairage indirect avec moins de lancer de rayons.

AMD a longtemps été en retard sur toute cette gamme de techniques de débruitage et d’amélioration, de même qu’avec l’implémentation et les performances en raytracing. La situation s’améliore avec FSR Redstone, qui veut agréger les technologies dévelopées par AMD dans le but de proposer un équivalent au RTX Kit, mais le retard reste mesurable.

Ainsi l’équivalent AMD du Ray Reconstruction de nVidia est le FSR Ray Regeneration. Un débruiteur basé sur un réseau de neurones qui prédit et restaure les détails raytracing. Il ne nécessite pas d’être lié à un framework de rendu spécifique, ce qui est un avantage pratique. La qualité est apparement en dessous de ce que propose nVidia.

Le FSR Radiance Caching est conceptuellement proche du NRC de nVidia, mais AMD est encore en phase de déploiement — la mise en production était prévue pour 2026.

AMD n’a pas de débruiteur analytique grand public équivalent au NRD, ce qui laisse encore un trou dans sa raquette pour les cartes qui ne peuvent pas utiliser le FSR Redstone.

Intel est le moins avancé des trois sur ce front. Son offre se concentre autour de XeSS 2.

XeSS 2 comprend trois technologies : XeSS Super Resolution (la mise à l’échelle AI), XeSS Frame Generation (interpolation de frames), et Xe Low Latency (XeLL), qui s’intègre au moteur de jeu pour réduire la latence d’entrée.

Intel n’a pas de débruiteur neural dédié au raytracing comparable au Ray Reconstruction ou au FSR Ray Regeneration. Pour le débruitage, les jeux utilisant les cartes Arc sont tributaires des débruiteurs intégrés aux moteurs (NRD si le développeur l’a intégré, débruiteurs propriétaires des moteurs comme Lumen, etc.).

Il faut mentionner que depuis des années, Intel et la communauté open source proposent Open Image Denoise (OIDN), un débruiteur libre basé sur des réseaux de neurones, utilisé notamment dans Blender et d’autres applications de rendu offline.

Également des algorithmes comme ReSTIR visent à réutiliser les tracés d’une image précédente pour réduire le temps de rendu.

Impact sur les performances

Pour se faire une bonne idée de l’impact du raytracing, il peut être intéressant de comparer des titres usant de cette technologie et de la rastérisation plus classique.

Cyberpunk 2077 est par exemple une vitrine du raytracing et du pathtracing.

Cette vidéo donne un bon aperçu technique, pour un rendu en 1440p, avec DirectX12 et en qualité utra. Une RTX 4070 Ti passe ainsi de 100 IPS en rastérisation à 80 en raytracing puis à 51 en pathtracing. La RX 7900 XTX d’AMD elle part de 134 IPS, puis 59 en raytracing et 20 en pathtracing. Et les deux carte utilisent DLSS/FSR pour atteindre ces chiffres.

La perte d’IPS est abyssale chez AMD, la faute à une première implémentation du raytracing alors que nVidia en était déjà à sa troisième itération. La situation s’est un peu améliorée avec les générations suivantes.

Techspot propose un comparatif très complet, avec non seulement l’écart de performance entre rastérisation pure et raytracing mais aussi avec les visuels pour constater (ou non) l’apport du raytracing.

Ce qu’on voit immédiatement c’est que dans beaucoup de jeux, la différence visuelle est minime. Les techniques classiques sont en effet terriblement efficaces pour imiter les effets de lumières, d’occlusion ambiante, d’éclairages indirects, etc. Sur d’autres titres (comme Cyberpunk), l’impact est beaucoup plus visible. Il y a donc une différence liée à l’utilisation du raytracing. La plupart des jeux présentés dans le comparatif utilisent le lancer de rayon dans une approche hybride, en complément de la rastérisation.

L’impact sur les performances est réduit, de même que la différence visuelle. Par ailleurs, la direction artistique change également la donne. Si un niveau ne comporte aucune surface réflective, on aura du mal à constater l’apport du raytracing.

De manière générale, si le lancer de rayon est pleinement utilisé, on table sur environ 30-50% de performances en moins. Et c’est déjà fantastique si on se rappelle d’où on vient.

Dans sa publication THE RENDERING EQUATION, Kajiya présente deux images qui font 256 × 256 pixels, générées sur un IBM-4341. La première ayant pris 401 minutes de temps CPU et la seconde 533 minutes.

On arrive aujourd’hui, 40 ans plus tard, à rendre des images en 4K avec une fluidité suffisante pour le temps réel. En outre, il est probable de voir les performances de rendu augmenter dans les prochaines années.

Impact sur le développement

Le raytracing et le pathtracing, c’est génial, mais pour le développeur qui doit sortir un jeu, ça représente un sacré paquet de nouvelles contraintes.

Déjà, le matériel supporté. Si vous développez un jeu avec le pathtracing comme pilier central, vous excluez de fait une bonne partie de votre audience potentielle. Les cartes avec des unités matérielles dédiées au lancer de rayon restent, en 2026, loin d’être universelles. D’après les enquêtes de Valve, la moitié des cartes les plus utilisées ne le gère pas ou pas très bien.

Les joueurs sur des machines plus modestes, ou sur des cartes trop anciennes, ne pourront pas jouer à votre jeu — ou joueront dans des conditions dégradées. Pour un studio qui vise la plus large audience possible, c’est compliqué.

C’est d’ailleurs pourquoi la plupart des jeux qui utilisent le raytracing le font de manière hybride. On conserve la rastérisation comme base, et assaisonnent avec du lancer de rayon sur certains effets précis : les reflets, les ombres, l’occlusion ambiante. Le raytracing est un bonus visuel pour ceux qui ont le matériel pour en profiter, pas une fondation sur laquelle repose tout le rendu. Mais certains jeux comme Indiana Jones et le Cercle Ancien utilisent explicitement et uniquement le lancer de rayon, rendant leur utilisation impossible sans une carte récente au grand dam des joueurs les moins bien lotis.

Pour le développeur, cela signifie qu’il faut souvent maintenir deux méthodes de rendu en parallèle : la rastérisation (et toutes ces techniques raffinées), et le raytracing. Deux approches très différentes, deux séries de bugs potentiels, deux validations distinctes. Conduisant inévitablement à un surcoût appréciable.

Le raytracing a besoin d’accéder à l’intégralité de la géométrie de la scène pour fonctionner, y compris ce qui n’est pas visible à l’écran. Là où la rastérisation peut se permettre d’ignorer allègrement tout ce qui est hors champ (autant que faire se peut). Le lancer de rayon, lui, doit potentiellement rebondir sur n’importe quelle surface. Cela implique de gérer des structures d’accélération (les BVH, Bounding Volume Hierarchies) qui doivent être mises à jour à chaque image pour les objets en mouvement. Un coût supplémentaire, là encore, même si c’est ce qui permet notamment d’afficher des réflexions complètes.

Du côté des artistes 3D, le passage au raytracing change aussi les habitudes de travail. Une part fascinante de ce métier consiste justement à tricher habilement : placer des sources de lumière pour compenser l’absence d’illumination globale, peindre à la main des cartes de lumière, jouer avec des sondes de réflexion, développer des shaders en araméen à la limite de la prestidigitation et du pacte diabolique. Des techniques qui demandent de l’expérience et un certain sens artistique du bricolage et de l’adaptation.

Avec une propagation de la lumière physiquement réaliste, certaines de ces astuces deviennent complètement inutiles — ce qui peut être un soulagement — mais certaines habitudes et flux de travail doivent être abandonnées ou repensées. Une lumière placée à un endroit étonnant pour une raison purement artistique va se comporter différemment dans un moteur qui simule la physique réelle de la lumière.

D’un autre côté, le fait de pouvoir visualiser le comportement réaliste de la lumière et des réflexions dans une scène permet aussi de s’en approcher plus finement avec les techniques classiques.

Le raytracing peut simplifier certains aspects du travail (plus besoin de calculer à l’avance des lightmaps, les réflexions et les ombres se génèrent automatiquement; tout ceci avec un coût en termes de performance. Un coût d’autant plus pesant que le prix des composants s’est envolé à cause de l’intelligence artificielle.

La question du DLSS 5 et plus généralement du rendu neural mentionnée plus haut ajoute une couche de complexité supplémentaire. Si le rendu peut être altéré (voir complètement généré) par un réseau de neurones, la notion même de direction artistique devient discutable.

Les artistes conçoivent une ambiance, une intention visuelle. Disent des choses au travers les images, la musique. Mais si tout passe ensuite dans une boîte noire qui réinterprète différemment ses entrées selon la carte du joueur, qui est vraiment responsable du résultat final ?

Sera-t-il encore satisfaisant pour les créateurs et les joueurs de concevoir des mondes virtuels dans ces conditions ?

C’est une question que l’industrie commence à peine à se poser sérieusement, et elle se pose pour toutes les œuvres artistiques depuis l’avènement de l’IA.

Enfin, si le développement se fait avec un moteur libre comme Godot ou Bevy, la situation est encore un peu particulière. On l’a vu plus haut, l’écosystème du raytracing et ce qui gravite autour est aujourd’hui dominé par des technologies propriétaires. Et les moteurs libres, par définition, ne peuvent pas les intégrer directement sans franchir des lignes qui iraient à l’encontre de leurs principes — et au moins de leur licence.

Concrètement, ça veut dire que le développeur qui choisit Godot aujourd’hui pour faire un jeu avec du raytracing va défricher un territoire sauvage. Les briques de base existent mais rien n’est prêt à être utilisé sans se retrousser les manches sérieusement.

Pour la mise à l’échelle, le FSR 2 est disponible, le FSR 3 intégrable. Les DLSS ou XeSS peuvent être implémentés, mais avec des licences à accepter, ce qui rend improbable toute intégration officielle dans le moteur. Le développeur qui veut tout ça devra donc assembler lui-même sa chaîne, en acceptant de dépendre de solutions tierces dont la maintenance n’est pas garantie par l’équipe de Godot.

Le plugin Solari de Bevy est pour le moment réservé aux cartes nVidia également, ça changera certainement rapidement.

Si on regarde du côté de Wicked Engine par contre on a bien un moteur supportant le raytracing et fonctionnant sur toutes les cartes. Il est un peu plus niche que Godot ou Bevy mais très impressionnant.

Pour revenir à Godot, ce n’est pas forcément un drame. Il dispose de techniques d’illumination globale très capables comme le SDFGI, le VoxelGI, les sondes de reflexion, etc, qui permettent d’atteindre des rendus très convaincants sans lancer un seul rayon. Et pour beaucoup de styles artistiques (jeux stylisés, pixel art, low poly) la différence entre raytracing et rastérisation ne se justifie pas vraiment.

Il y a eu d’autres approches ces dernières années qui ont eu un impact sur les moteurs, les techniques de géométrie virtuelle par exemple. Nanite, disponible dans l’Unreal Engine en est un bon exemple.

Les maillages sont découpés en hiérarchies de clusters de triangles lors de l’import, puis ces clusters sont échangés à la volée selon la vue caméra, sans couture visible. Remplaçant les techniques plus communes de LOD. En pratique, ça veut dire qu’on peut importer directement des scans photogrammétriques de plusieurs millions de polygones, sans passer par les étapes habituelles de re-topologie et d’optimisation. Permettant de ne plus se soucier du budget de polygones et des LODs.

Du moins dans certaines limites. Si cette approche permet d’avoir des transitions inexistantes entre différents niveaux de détails, il n’en reste pas moins que dans beaucoup de cas, une utilisation des LODs et un bon travail d’optimisations des ressources et du maillage permet d’atteindre de meilleures performances. Importer les yeux fermés des object 3D de plusieurs millions de polygones sans même s’en soucier implique forcément des cas sous optimisés. Mais la technologie est là et mature tranquillement.

Introduction To Modern Rendering présente d’une façon digeste et intéressante les technologies du raytracing et des mesh shader.

Du côté des moteurs libres, c’est en chantier. La proposition pour Godot date de 2021, ouverte peu après l’annonce d’Unreal Engine 5, et est toujours ouverte. Rien de concret n’a atterri dans le moteur à ce jour. Bevy est plus avancé sur le sujet : son contributeur JMS55 (encore lui, c’est la personne derrière Solari) travaille activement sur une implémentation, et son article sur la version 0.16 détaille les avancées récentes — notamment l’amélioration de la qualité du DAG (la hiérarchie de clusters). C’est encore une fois très agréable de lire ces articles riches de détails et accessibles.

Bref, pour qui veut être à la pointe de la technique sans passer par du code propriétaire, la route est encore longue. La bonne nouvelle, c’est qu’elle est libre.

De nouveaux venus (Moore Threads, Lisuan Technology)

Le marché des GPU est depuis très longtemps un duopole de fait entre nVidia et AMD, avec Intel en troisième position encore fragile. Bon, OK, nVidia rafle l’essentiel du marché. Mais AMD tire son épingle du jeu (et sous Linux ils jouissent d’une réputation bien plus reluisante que nVidia).

Mais depuis quelques années, avec le contexte géopolitique tendu, la Chine a accéléré le développement de ses propres fabricants de cartes graphiques. Les restrictions américaines à l’exportation de composants avancés vers la Chine, qui concernent notamment les GPU nVidia les plus puissants, n’y sont pas pour rien.

Deux sociétés font parler d’elles : Moore Threads et Lisuan Technology.

Moore Threads est la plus ancienne des deux, fondée en 2020 par Zhang Jianzhong, ancien vice-président de nVidia Chine. Ses cartes actuelles, les MTT S80 et S90, existent depuis quelques années déjà, mais sont restées assez loin derrière la concurrence. Pour la prochaine génération, basée sur l’architecture Huagang, Moore Threads annonce pour sa puce Lushan des gains de 15x en performance dans les jeux AAA, 50x en raytracing, et 16x en traitement géométrique. Des chiffres spectaculaires, mais sans spécifications ni données de benchmarks à l’appui pour l’instant. Et bien sûr, tout dépend d’où on part.

À prendre avec des pincettes donc, mais l’ambition est là et les moyens aussi. La MTT S90 serait au coude à coude avec la RTX 4060.

Ce qui n’est pas une mince affaire pour un fabricant qui n’existait pas il y a 6 ans.

Lisuan Technology est un peu plus récente encore puisque fondée en 2021. Aucune carte n’est encore sortie (même si les envois auraient commencé).

La carte gaming LX 7G106, fabriquée par TSMC en 6nm, est prévue pour le 18 juin 2026 en Chine. En termes de performances synthétiques, elle se situerait dans les parages d’une RTX 4060.

En revanche, la carte ne supporte pas le raytracing.

Ce qui est notable pour nos sujets, c’est que ces deux acteurs, à des stades différents de maturité, arrivent dans un écosystème où les technologies de rendu avancé sont dominées par des standards propriétaires. Pas de DLSS, pas de FSR 4, pas de Ray Reconstruction. Ils devront soit implémenter leurs propres équivalents, soit s’appuyer sur les technologies agnostiques comme le FSR 2/3 ou le NRD d’nVidia.

Leur impact sur le marché mondial restera sans doute limité à court terme, les joueurs ayant de solides alternatives. Mais pour le marché chinois, qui représente une part considérable des joueurs PC mondiaux, ces alternatives domestiques ont une pertinence réelle, et représente des enjeux en termes d’autonomie. Si l’un d’eux parvient à produire une carte compétitive avec des pilotes stables, ce sera un signal fort que le quasi-monopole de nVidia n’est pas éternel.

Espérons que les pilotes seront libres et les technologies développées aussi, ce serait bien.

Et les performances dans tout ça

On a vu défiler beaucoup de technologies dans cet article. Des acronymes abscons, des architectures, des promesses de gains en tous genres. Mais si on prend un peu de recul : est-ce que tout ça rend les jeux plus agréables à jouer ?

Non. Bien sûr. Évidemment.

Attention, je suis aussi sensible que n’importe qui à de beaux graphismes, mais le nerf de la guerre n’est pas là. Surtout quand on voit que le prix des GPU, du stockage, de la RAM et par effet de bords, de tous les éléments d’un PC, ont flambé ces dernières années. Sous l’effet de la demande apparemment infinie de l’industrie de l’IA. Les cartes qui permettent de profiter correctement du raytracing et des technologies qui l’accompagnent se situent dans des gammes de prix de plus en plus élevées.

Leur consommation ne cesse de grimper (une RTX 5090 est une grosse brique tant son radiateur est gros), de même que leur impact écologique. On parle tout de même de composants PC tellement énergivores qu’ils forcent à changer toute l’alimentation de la machine et amènent avec eux une nouvelle norme de connecteur d’alimentation (qui n’a pas forcement très bonne presse).

Et même à des niveaux plus raisonnables, une carte milieu de gamme récente représente un investissement conséquent pour un résultat qui, on l’a vu, n’est pas toujours spectaculairement supérieur à ce qu’on obtenait avant.

L’augmentation des prix est telle que la demande pour des cartes mère en DDR3 poussent certains fabriquant à renouveler leurs stocks.

Ensuite, le Raytracing, les DLSS, FSR, débruiteurs neuraux, la génération d’images, la géométrie virtuelle. Chacune de ces technologies a été conçue pour résoudre un problème (parfois causé par la technologie qui le précède), et chacune en a introduit de nouveaux. Des artefacts visuels, de la latence, des incompatibilités entre fabricants, des exigences matérielles toujours plus élevées, des licences propriétaires. L’empilement de solutions finit par former une pile fragile, le jeu vidéo est un assemblage hétéroclite de techniques barbares et sauvages depuis ses débuts, mais on commence — avec ces nouvelles technologies biberonnées à l’IA — à s’éloigner de la recherche algorithmique pure, de cet esprit MacGyver qui caractérise si bien le développement de jeux vidéos, pour arriver sur une logique de boîte noire.

Ou bien c’est dans la droite ligne de l’héritage des pionniers du jeu vidéo, et ce sentiment n’est en fait qu’une incompréhension face à une révolution trop rapide pour être assimilée correctement.

Face à ça, aller à contre-courant est non seulement possible, mais peut être couronné de succès. Des jeux comme Celeste, Hollow Knight, Vampire Survivor ou plus récemment Balatro, n’ont aucun raytracing, géométrie virtuelle ou débruiteur neural. Ils tournent sur des machines modestes, parfois vieilles de dix ans ou plus, et se jouent avec un plaisir non moins vif.

À l’autre bout du spectre, des productions AAA ultra-techniques ont déçu leurs joueurs malgré — ou parfois à cause de — leur sophistication technique. Comme Pokémon Legends: Z-A qui (au-delà son contenu vidéoludique) souffre d’un manque flagrant d’optimisation, ce qui est un comble quand on parle de la licence Pokemon. Une licence dont les premiers jeux repoussaient les limites de leur support physique.

La technique se remarque essentiellement quand elle est mauvaise. Une conception ancienne mais bien réalisée sera souvent plus agréable qu’une autre plus récente mais à l’implémentation faillible.

De plus en plus de joueurs en ont marre de devoir investir dans des composants toujours plus puissants et réclament des jeux plus optimisés. Mais les grandes compagnies ont apparemment d'autres préoccupations.

La rastérisation bien maîtrisée, avec les techniques classiques évoquées en début d’article, permet encore en 2026 de produire des rendus magnifiques et des expériences fluides sur le parc matériel le plus large. Des moteurs comme Godot, même sans SDFGI ou sondes de réflexion, permettent d’atteindre des résultats visuellement très convaincants sans toucher les limites du matériel.

Je ne doute pas que le raytracing apporte énormément au jeu vidéo, ses qualités sont indéniables. Seulement dans le contexte actuel, je ne cracherais pas sur plus d’optimisation.

Possédant un Steam Deck de Valve, j’aime le fait de pouvoir baisser la consommation du SOC de la console à 3 ou 5 watts.

Ça rend la machine silencieuse, efficiente, et la batterie tient plus longtemps.

Jouer à Batman: Arkham Knight dans ces conditions permet d’atteindre 60 image par secondes quasiment tout le temps. Ce qui est impressionnant, car en plus le jeu est vraiment très beau.

Il a déjà 11 ans, mais reste magnifique. On pourra se rappeler qu’en 2015 il avait souffert de sa mauvaise optimisation.

La grogne des joueurs poussant Rocksteady Studios à mettre la distribution en pause, le temps de résoudre les problèmes techniques avec l’aide d’AMD et nVidia. Problèmes qui auraient évidemment pu être remontés et corrigés en phase de test.

Aujourd’hui on voit des jeux sortir sans la prise en charge de certaines cartes, comme Crimson Desert (qui recevra finalement plus tard la gestion d’Intel), des performances désastreuses à l’image de Borderlands 4 qui semble avoir réussi à transformer ses joueurs en bêta-testeurs, ou bien découpés à la tronçonneuse pour le vendre petits bouts par petits bouts : (Les Sims 4 on parle de toi).

Alors, quand en plus de ces problèmes que les industriels du jeu vidéo nous ont apportés, on ajoute du raytracing uniquement pour surfer sur la vague, ça ne fait qu’enfoncer le clou dans le cercueil de nos machines.

D’un autre point de vue, et en mettant de côté le raytracing, les technologies comme le DLSS et le FSR permettent de prolonger la durée de vie d’un matériel vieillissant. En tout cas, si ce n’est pas utilisé comme un pansement pour palier des performances passables.

Heureusement, des productions comme Resident Evil 4 ou Red Dead Redemption 2 montrent qu’il est encore possible de faire des jeux visuellement magnifiques (et surtout de bons jeux) qui tournent avec trois fois rien. Split Fiction (qui possède un gameplay en perpétuelle évolution), est visuellement superbe et tourne au poil sur une RX580.

Source : The Gamer

On aura sûrement le meilleur des deux mondes un jour ! Enfin j’espère, sinon on pourra toujours se réfugier dans le jeu de rôle papier.

Aller plus loin

- Realtime Raytracing in Bevy 0.18 (Solari) (43 clics)

- Le rendu 3D, rétrospective (par small_duck) (37 clics)

- An improved illumination model for shaded display (49 clics)

- The rendering equation (49 clics)

- Introduction To Modern Rendering (27 clics)

- Surfel-based global illumination on the web (23 clics)

# Réponse : non

Posté par rewind (Mastodon) . Évalué à 10 (+15/-3).

Un jeu vidéo, ce n'est pas que du rendu graphique (heureusement). Donc, on va continuer à faire des jeux libres originaux avec les techniques graphiques pas si vieilles qui donnent des résultats pas si mal que ça.

[^] # Re: Réponse : non

Posté par raum_schiff . Évalué à 4 (+3/-0).

+1

Pour ajouter que le titre de la dépêche est un peu trompeur, car ce genre de technologie cible les jeux 3D orientés "rendu réaliste". Même dans ce cas, les vieilles techniques (probes, occlusion pour la lumière + shaders composites) marchent très bien et sont peu gourmandes.

Pour les visuels on peut faire dans la 3D (très) artistique sans vouloir être photo-réaliste.

Mais à voir la majorité des commentaires suivants, la question se focalise sur le matériel et le côté propriétaire de ces technologies avec la petite chanson "l'essayer c'est l'adopter … comme standard".

Y'a comme un côté retour vers le futur du passé ! (toutes proportions gardées).

[^] # Re: Réponse : non

Posté par Aldebaran (site web personnel) . Évalué à 3 (+2/-0).

J'avoue, le titre est un peu clico-raccoleur ;)

On peut très bien faire des jeu non photo réaliste, j'en parle plusieurs fois d'ailleurs. Et même si je suis très intéressé par cette méthode de rendu (parce que la technique c'est cool quand même), je privilégie la rastérisation quand je joue perso.

Je n'ai pas encore trouvé de titre me faisant préférer le raytracing en me faisant oublier l'impact sur les perfs.

Après même sur des direction artistique non photo réalistes, ça peut avoir un intérêt (pour avoir de belle réflexions temps réel). C'est une méthode rendu, une technique quoi.

Ce qui me chiffonne (et je pense que c'est ressortit dans la dépêche), c'est l'emballement qu'il y a eu sur ce sujet au niveau des AAA. Mais bon, les AAA ont de plus en plus de problèmes, c'est seulement un de plus et à mon avis pas le pire.

[^] # Re: Réponse : non

Posté par raum_schiff . Évalué à 2 (+1/-0).

Ben moi aussi !

En ce qui me concerne, je l'utilise pour du rendu statique sur Blender quand je sais qu'entre une vitesse de calcul dégradée (due au raytracing), et le fait de devoir ajuster une dizaine de probes et de lumières; je vais gagner en temps pour avoir le rendu que je veux (un soleil bien placé et zou!).

Pour les jeux c'est différent, la vitesse par frame compte, et perdre des FPS pour avoir (par ex) de la transluminescence dans la peau d'un PNJ à 2 mètres; ça sert à quoi ?

Pour les AAA, franchises ont été utilisées jusqu'à la corde, donc à défaut de proposer du gameplay original (pas mal de jeux indés y arrivent pourtant); ils cherchent des arguments ailleurs, vers le matos…

[^] # Re: Réponse : non

Posté par Aldebaran (site web personnel) . Évalué à 1 (+0/-0).

Je vois, perso je m'amuse pas mal avec Godot, j'aimerais bien tester le raytracing uniquement sur les réflexions passé une certaine valeur de roughness.

Ça permettrait d'avoir de beaux reflets potentiellement moins consommateurs que les réflexions planaires (même si on peut vraiment bien tricher avec le FSR2 sur la caméra des planaires) et surtout plus simplement (une caméra par surface planaire affichée, ça limite forcément).

[^] # Re: Réponse : non

Posté par raum_schiff . Évalué à 2 (+1/-0).

Si c'est faisable sur le moteur de Godot (j'utilise pas donc …).

En ce qui concerne Blender, les shaders on un light Path mais c'est du booléen donc aucun contrôle "fin" suivant la roughness ☹️; le seul moyen de contrôler les rebonds de rayons est au niveau du rendu global.

Ça marchait avant la 4.2 seulement sur Cycles, mais depuis Eevee en bénéficie aussi.

[^] # Re: Réponse : non

Posté par Aldebaran (site web personnel) . Évalué à 2 (+1/-0).

Arf, non Godot ne supporte pas le raytracing en l'état (pas sans le fork nvidia et une carte nvidia, ou via le code de J.E.N.O.V.A qui est non distribué (quand je lui ai demandé si ça serait libéré, le dev (Architect) m'a dit que non, apparemment il veut faire un fork du moteur mais je ne sais pas ou ça en est et comme c'est proprio ça m’intéresse moins, le pathtracer serait libéré à terme mais bon on verra bien).

Je suis moins au fait de blender, je sais juste que l'import dans Godot du roughness d'un matériau PBR est buggé en GLTF (fixé à 0.5).

[^] # Re: Réponse : non

Posté par abriotde (site web personnel, Mastodon) . Évalué à 3 (+1/-0). Dernière modification le 28 mai 2026 à 22:21.

N'empêche qu'il y a une vrai question de soulevé. Et puis il y a toujours la question de vas t'on encore coder? (dis autrement, qui s'amuse en encore à faire ses meubles en bois, à la main sans clous ni vis?)

Ace stade, je ne penses pas que ce soit moins bien ou mieux, mais ce qui est sûr c'est qu'il y a de vrai changements avec de vrai chalenges.

Sous licence Creative common. Lisez, copiez, modifiez faites en ce que vous voulez.

[^] # Re: Réponse : non

Posté par BAud (site web personnel) . Évalué à 3 (+1/-0).

tu peux faire plein de boîtes avec une découpeuse laser et assembler ensuite les parois

https://boxes.hackerspace-bamberg.de/?language=fr le plus diversifié et complet

https://cyberweb.cite-sciences.fr/wiki/doku.php?id=projets:generateur_de_boites

ya même une extension Laser cut box intégrée à inkscape pour cela

https://inkscape.org/fr/~FrankSAURET/%E2%98%85boite-brique-laser-cut-boxes

[^] # Re: Réponse : non

Posté par Aldebaran (site web personnel) . Évalué à 3 (+2/-0).

Je suppute qu'en disant à la main, abriotde pensais plus à l'utilisation de ciseaux, gouges et scies a mains pour réaliser de beaux assemblages classique ;)

Et effectivement y a pas grand monde qui continue à faire des mortaises ou à dégauchir une planche à l'ancienne. En tout cas ça ne doit pas représenter un gros volume par rapport au nombre de meubles vendus par ikea ou but.

Il reste les passionné comme d'habitude. Eux ils s'en fiche d'être productifs, ils font ça pour la beauté du geste, l'art, l'amour du travail bien fait et l'appétit du copeau.

On a déjà plus ou moins ce genre de personnes dans l'informatique en plus.

[^] # Re: Réponse : non

Posté par Ysabeau 🧶 (courriel, site web personnel, Mastodon) . Évalué à 6 (+3/-0).

Il faut savoir par exemple que la Haute couture, par définition légale (en France tout au moins) exige que les coutures soient faites manuellement. En matière d’ébénisterie et de menuiserie, je ne serais pas étonnée (en fait j’en suis sûre) qu’outre des passionné·e·s il y ait des ateliers professionnels qui continuent à travailler avec des outils à main (pas pour tout) pour des réalisations et des restaurations de haut niveau.

Je n’ai aucun avis sur systemd

# Path tracing et BS Marketing NVidia

Posté par YBoy360 (site web personnel) . Évalué à 8 (+6/-0).

Le ray tracong est sans doute la voie, mais pas via celle de NVidia..

J'ai l'impression qu'on réinvente des techniques des années 60 sans arrêt… Et les DLSS 12 ou 22 seront toujours moins efficaces que ce que fait Apple (et bien d'autres avant) en réduisant la consommation, la complexité des puces et la bande passante mémoire en utilisant les technos PowerVR, un truc européen (anglais, comme ARM) …

Les rois du Bulshito, de l'évolution incrémentale qui faut tout racheter dans 2 ans, des puces qui polluent à fabriquer et à utiliser, parce que pas efficace par rapport à ce que l'on savait faire il y a 35 ans.

Bref, si MS ne fiançait pas sans compter les acteurs de l'IA et n'avait pas favoriser NVidia avec DirectX 8, ils seraient anecdotiques.

I use Arch BTW

[^] # Re: Path tracing et BS Marketing NVidia

Posté par Thomas Debesse (site web personnel, Mastodon) . Évalué à 9 (+6/-0).

L’efficacité d’Apple tient essentiellement dans le fait que tout est très intégré et soudé, un peu comme dans une PlayStation ou une Xbox. Ça fait du matériel jetable irréparable, mais les raccourcis pris apportent parfois des gains significatifs comme la bande passante, et aussi comme pour les consoles le logiciel peut faire des suppositions très osées, et possiblement déléguer des tâches au CPU pour suppléer le GPU car la mémoire est partagée.

Mais même dans un Apple, l’architecture PowerVR souffre de ses limitations. Ça reste une architecture tiled renderer comme dans la plupart de nos téléphones et les machins-pi même quand ce sont d’autres marques (par exemple Broadcom a une architecture en tiled renderer, aussi). Cela signifie que même les dernières versions d’OpenGL 4.6 (pourtant l’ancienne techno avant Vulkan) ne peuvent pas être implémentées sans émuler certaines fonctionnalités (en particulier l’extension

ARB_texture_barrierd’OpenGL 4.5), et cette émulation requiert d’aller contre l’architecture qui est physiquement incompatible et de perdre les gains apportés par le design. Apple ne s’embête même pas à le faire et se limite à OpenGL 4.1, et ils l’ont déprécié OpenGL de toute façon, c’est pratique. 😁️On retrouve les mêmes limitations qu’AGX d’Apple dans les MTT S80 de Moore Threads, car tous deux basés sur PowerVR: pas de

ARB_texture_barriercommen mentionné, mais aussi des triangles qui ne sont tout simplement pas dessinés (AGX, MTT, PVR). Ce dernier bug est très certainement matériel, dans le design PowerVR lui-même. Le bug se reproduit quelque soit le pilote (asahi, mtgpu et pvr sous Linux par exemple), quelque soit le système d’exploitation (Linux, macOS, je n’ai pas encore testé Windows) et quelque soit l’architecture hôte (x86, arm64, riscv64).ce commentaire est sous licence cc by 4 et précédentes

[^] # Re: Path tracing et BS Marketing NVidia

Posté par AlexTérieur . Évalué à 3 (+2/-0).

PowerVR… c'est pas le truc où tout le monde a pleuré pour avoir des pilotes libres et qui en guise de respect du monde libre les développeurs ont fournis un pilote toujours plus fermé mais surtout de plus en plus daubé ?

# Et les moyens traditionnels ?

Posté par AlexTérieur . Évalué à 3 (+2/-0).

J'avais vu il y a quelques temps une vidéo explicative d'un youtubeur français (cocorico) très convaincante sur comment on générait jusqu'à maintenant l'éclairage en mode "rastérisation" pure et que cette méthode s'appuyait sur une approximation mathématique connue (comme il y en a beaucoup en mathématique) qui évite des calculs incroyablement lourds (du genre à éviter une accumulation exponentielle de nécessité de puissance de calculs) et sans laquelle encore aujourd'hui on aurait du mal à avoir des jeux avec un éclairage "temps réel" convaincant (en dehors du nouveau et désormais sacro-saint RT). Malheureusement je n'arrive plus à remettre la main sur cette vidéo.

Il y a bien eu des progrès sur cette méthode "traditionnelle" non ?

[^] # Re: Et les moyens traditionnels ?

Posté par AlexTérieur . Évalué à 5 (+4/-0).

Bon les techniques du style "illmuination globale" SSAO etc. c'est bien la suite de ce que j'appelle la "méthode traditionnelle" j'avais mal saisi.

Mais j'ai du mal à voir pourquoi on s'est jeté sur le Ray Tracing, il n'y aurait qu'une seule voie possible selon certains…

# Typo + meri

Posté par dovik (site web personnel) . Évalué à 4 (+2/-0). Dernière modification le 19 avril 2026 à 12:20.

Merci pour la (longue et intéressante) dépêche.

Quelques typo :

Manque le "est".

"épingle"

"impact"

[^] # Re: Typo + meri

Posté par Benoît Sibaud (site web personnel) . Évalué à 5 (+2/-0).

Corrigé, merci.

[^] # Re: Typo + meri

Posté par Aldebaran (site web personnel) . Évalué à 3 (+2/-0).

Merci à vous deux (et aux relecteurs qui m'ont aidés à corriger mes fautes) !

# Dépendance aux drivers

Posté par mrintrepide . Évalué à 3 (+2/-0). Dernière modification le 19 avril 2026 à 13:53.

Il faut parler du retour des API et librairies propriétaires intégrées aux pilotes (Windows), en échappant aux API système comme DirectX ou Vulkan.

Seul le RayTracing a été intégré, on attend la SR et la FG.

Microsoft avait annoncé une API dans DirectX (DirectSR ?), j'entends plus rien dessus depuis.

A noté que les librairies FRS4 fonctionnent avec le SDK du FSR 3.1+

Il est à parier que le FSR4 INT8 est une exclu Sony.

PS : pour le DLSS 5 ou concurrent, le rendu sera différent entre chaque marque et si le pilote modifie les modèles avec le temps aussi.

[^] # Re: Dépendance aux drivers

Posté par AlexTérieur . Évalué à 2 (+1/-0).

Apparemment c'est en cours de développement et bien avancé chez Crosoft :

https://hardwareand.co/actualites/breves/dxr-1-2-dxr-2-0-et-les-travaux-sur-les-algos-devraient-changer-l-implementation-du-lancer-de-rayons-dans-les-jeux

Je sens que le monde libre va reprendre du retard…

# Les GPUs chinois

Posté par Thomas Debesse (site web personnel, Mastodon) . Évalué à 10 (+12/-0).

Il faut aussi compter Zhaoxin pour les graphismes intégrés. Les processeurs Zhaoxin intègrent une puce graphique du même nom. Je ne sais pas quelle est la technologie derrière. Le CPU est un descendant du Via lui-même descendant du Cyrix, je ne serai donc pas surpris si la partie graphique descend de S3 à cause du lien historique entre Via et S3, mais la partie S3 de Via avait été revendue à HTC il y a déjà 15 ans en 2011… Je n’ai donc aucune idée pour le moment. Je possède un KX6000 (un KX-U6780A exactement) et le pilote graphique pour Linux est buggé, GNOME fonctionne mais Unvanquished met les pieds dans un bug du pilote. Je ne l’ai pas testé sous Windows (parce que Windows c’est pénible 😅️). Le pilote

zhaoxinest propriétaire, je n’ai pas fait plus de recherches sur le pilote. Je devrais recevoir un KX7000 cette année, avec un pilote plus à jour.Les Moore Threads, comme les Apple AGX, sont des dérivés de PowerVR et en partagent même certains bugs. Le pilote

mtgpuest aussi propriétaire, mais j’y trouve plein de traces de Mesa dedans (ce qui est possible légalement car Mesa est principalement sous licence permissive MIT). Je possède une MTT S80.Selon Wikipédia, Lisuan Tech aurait été fondé en 2021 par trois anciens employés de S3 Graphics, donc là on retrouvera peut-être un héritage de S3, du moins dans le savoir-faire, puisque je ne sais pas s’ils ont des liens avec HTC.

Je parlerai un peu du MTT S80 dans la dépêche en préparation pour la sortie d’Unvanquished 0.56, mais je prévois dans les prochains mois de développer une série de publications sur le développement informatique chinois (CPUs Zhaoxin, GPUs MTT, etc.). L’avantage de ces technologies chinoises c’est qu’elles sont pensées pour s’intégrer directement avec les technologies existantes (notamment le fait que Zhaoxin soit du x86). Là où la France commence péniblement à envisager du Linux pour ses administrations pour gagner un peu de souveraineté côté logiciel, la Chine fait déjà dans le dur et a déjà ses CPUs et ses GPUS… Et alors que le monde est en pénurie de RAM et de SSD, leurs usines (CXMT et JHICC pour la RAM, YMTC pour les SSD) dont ils ont lancés la construction il y a 15 ans entrent désormais en production (voir la vidéo de Gamers Nexus sur le sujet)…

Le problème c’est que pour la France, passer d’une dépendance américaine à une dépendance chinoise, c’est toujours une dépendance. Donc ces produits peuvent être bienvenus en terme de mise en concurrence, mais ce n’est pas une aubaine en terme de souveraineté, que ce soit de l’américain ou du chinois, c’est kif-kif on reste entièrement dépendant de puissance étrangères avec un risque aussi grand de sanction ou de backdoor. Acheter du américain souverain ou du chinois souverain ne fait pas de nous des souverains, tout comme imiter un modèle ne fais pas de nous des modèles mais des suiveurs. Mais si déjà on était des suiveurs, nous ne sommes que des consommateurs…

Enfin bref, je m’égare, mais si tout se passe bien je devrais entamer une série sur ces technologies dans l’année, du point de vue linuxien. D’ailleurs je serai très intéressé de mettre la main sur une carte Lisuan Tech donc si des gens ont des relations en Chine ça m’intéresse.

À propos de relations en Chine, indépendamment de ces GPUs chinois, et en fait plus difficile à trouver que ces GPUs chinois, je cherche à mettre la main sur la carte mère MS-BA17 (part number 109-S05040-00D). C’est un produit américain vendu exclusivement sur le marché intérieur Chinois, ce commentaire sera peut-être le tout premier commentaire à référencer ces références sur le web occidental (et à remonter dans vos recherches), trois ans après la mise sur le marché du produit en question. Rien que pour le fun, vous pouvez essayer de rechercher cela sur les moteurs de recherche occidentaux type Google, DuckDuckGo, Yahoo, Bing ou QWant, vous ne recevrez aucune réponse (vérifiez). Il existe un troisième nom qui a traversé le grand pare-feu mais je le tais pour l’exercice. Je peux fournir des photos pour prouver que le produit existe avec ces références. 😜️

ce commentaire est sous licence cc by 4 et précédentes

[^] # Re: Les GPUs chinois

Posté par Renault (site web personnel) . Évalué à 7 (+6/-2). Dernière modification le 19 avril 2026 à 15:42.

En même temps c'est assez irréaliste que la France soit indépendante du côté des semi-conducteurs. C'est probablement la mauvaise échelle pour penser cela, c'est plutôt au niveau européen que cela doit être envisagé pour avoir un marché assez grand pour rentabiliser les coûts fixes énormes de cette industrie.

La Chine est assez grande pour envisager ce genre d'indépendance technologique dans son coin.

EDIT : je précise que ta proposition de dépêche sur les produits chinois m'intéresse.

[^] # Re: Les GPUs chinois

Posté par Thomas Debesse (site web personnel, Mastodon) . Évalué à 9 (+6/-0). Dernière modification le 19 avril 2026 à 15:52.

On ne peut pas tout faire, et pas tout d’un coup, mais si déjà on avait une usine de RAM en France et une usine de CPUs en Italie, ou l’inverse, ça irait déjà mieux… Et avoir une usine en France ne signifie pas se limiter au marché français, on vend bien du champagne jusqu’au bout du monde…

Ça fait déjà 5 ans que QNAP a introduit du Zhaoxin dans certains de ses NAS (ils ont aussi du AMD, du Intel et du ARM). On peut imaginer vendre des puces française dans des tas de produits sans même commencer à concurrencer le marché du PC traditionnel.

ce commentaire est sous licence cc by 4 et précédentes

[^] # Re: Les GPUs chinois

Posté par Thomas Debesse (site web personnel, Mastodon) . Évalué à 7 (+4/-0). Dernière modification le 19 avril 2026 à 16:02.

Je me rends compte que cet article de 2021 du Comptoir du Hardware sur les QNAP Zhaoxin donne un lien vers un autre article de 2020 qui partageait une information de Zhaoxin qui prévoyait de sortir des cartes graphiques dédiées en 2021. Bon ce n’est pas arrivé, mais les puces graphices Zhoxin existent bien comme puce intégrée dans les CPUs. L’article fait aussi des pronostiques sur la possible technologie graphique S3 (certains se souviendront des S3 Chromes…), en précisant que si Via a vendu S3 à HTC, Via auraient conservé une licence S3… Je creuserai tout ça, pour le moment ce n’est que du pronostic.

ce commentaire est sous licence cc by 4 et précédentes

[^] # Re: Les GPUs chinois

Posté par Renault (site web personnel) . Évalué à 5 (+2/-0).

Bien sûr, mais cela ne change pas ce que je dis.

Lancer de telles usines cela reste cher et long. C'est plus facile d'avoir des financements privés et publics si on peut garantir des débouchés. Cela passe par des commandes ou des régulations pour garantir des achats groupés locaux et souvent les acteurs publics sont les premiers à le faire.

La France seule n'a pas la possibilité de garantir ce volume nécessaire, faut trouver d'autres acheteurs à l'étranger et avant de lancer la construction de l'usine. Je ne crois pas que beaucoup d'industriels étrangers vont se battre pour cela sans contraintes externes, d'autant que nous n'avons pas à ce jour de tels produits démontrant le savoir faire de notre pays qui a des compétences connues pour des micro contrôleurs mais pas des puces à haute performance.

On le voit d'ailleurs à d'autres niveau au niveau européen. Le secteur de la défense est très fragmenté et cela freine la possibilité d'avoir des programmes ambitieux malgré le fait que l'Europe est un exportateur majeur d'armes dans le monde. Car peu de coordination des projets au niveau européen ce qui mène à des projets dupliqués mais moins ambitieux et le peu de garanti concernant le volume de production.

D'où l'intérêt de le faire au niveau européen, cela ouvre des horizons et garanties plus larges et évitant les redondance : certains États produisent des composants type mémoire, d'autres des CPUs, etc. Et on a assez d'industriels sur le continent pour qu'on puisse garantir un volume de vente dans tous les cas.

La Chine n'a pas ce problème, elle est plus uniforme sur ce plan, et la main mise du parti permet la Chine de financer des usines non rentables si nécessaires et de forcer ses entreprises à acheter le produit qui en sortira à un volume tel que ça sera intéressant de mener le projet au bout. Et ensuite les produits pourront s'exporter ailleurs, les acheteurs étrangers pourront s'en servir sans prendre de risque et en sachant les capacités réelles des puces produites avant ce qui est un atout important.

[^] # Re: Les GPUs chinois

Posté par Aldebaran (site web personnel) . Évalué à 4 (+3/-0).

J'avoue qu'un peu de concret au niveau européen serait appréciable. Ce serait formidable d'avoir des usines en europe capable de produire des puces et de la mémoire.

Bon, les acteurs actuels ne sont pas bien indépendants non plus, il me semble que la pluspart des fabriques utilisent des machines de lithographie venant de chez ASML basé en hollande.

Je ne sais pas si des taxes sur les produits étrangers serait un bienfait ou une bétise.

Ce n'est malheureusement pas la seule dépendance que l'on a.

[^] # Re: Les GPUs chinois

Posté par Renault (site web personnel) . Évalué à 5 (+3/-1).

De toute façon, aucun pays ne peut être autonome pour tous les produits et à toutes les étapes clés. Même la Chine et les USA, relativement autonomes sur de nombreux plans, dépendent d'autres pays ne serait-ce pour la matière première ou certains équipements de pointe.

L'UE n'a pas la capacité de faire mieux qu'eux et aucun pays ne peut avoir une autonomie complète.

Et même s'ils peuvent produire pour eux, ils dépendent aussi de clients pour garantir leur force économique et stratégique. La Chine et les USA peuvent faire des embargo de produits à destination de l'UE mais c'est aussi à double tranchant car ces entreprises ne pourront pas remplacer un si gros client si facilement sans impact pour eux. Sans compter la rupture de confiance qui peut faire des dégâts à long terme envers les pays lésés mais aussi les autres qui pourraient se sentir menacés. Les USA sont en train de le vivre avec la stratégie de Trump qui peut potentiellement donner des gains de courts termes mais très pénalisant à long terme.

C'est un aspect compliqué dans la question des dépendances, globalement les feuilles de route de l'UE sur les différents sujets suggèrent que :

C'est je pense la bonne approche concernant cette question et dans le cas des processeurs être capable de produire un peu de RAM ou gros CPUs devrait entrer dans ce cadre même si le volume ne serait pas nécessairement suffisant pour que tout PC européen utilise ces puces. Maintenant entre les souhaits et la réalité, il y a un grand pas à franchir qu'on peine à faire pour le moment.

[^] # Re: Les GPUs chinois

Posté par Thomas Debesse (site web personnel, Mastodon) . Évalué à 5 (+2/-0).

Carrément, c’est pour ça que la Chine s’y est mis il y a 15 ans. Ce sont des chantiers similaires au nucléaire civil ou le TGV, qu’on a réussi à mener à bien par le passé.

Les projets Européens c’est à double tranchant. Faire travailleur plusieurs pays sur un même projet c’est casse-gueule. Ça marche avec l’ESA, mais on voit par exemple que dans l’armement ça fait perdre du temps à tout le monde.

L’avantage de l’informatique c’est que c’est modulaire, et faire travailler des pays différents sur un produit différent a plus de chance de succès. Un pays qui fait des CPUs, un pays qui fait des mémoires, un pays qui fait des GPUs… Ça garantie que chaque pays n’ait pas besoin de « tirer la couverture à lui » à l’intérieur même du projet et élimine les conflits afférents et permet de s’y donnant à fond, tout en garantissant une collaboration par la seule dynamique de marché : les uns achetant mutuellement aux autres les pièces qu’ils ne produisent pas eux-même.

On peut par exemple imaginer un PC 100% européen avec un CPU 100% français, de la RAM 100% italienne, un SSD 100% allemand, un GPU 100% espagnol sur une carte-mère 100% belge, par exemple. Chacun s’assure ainsi un haut niveau de souveraineté sur un produit essentiel, tout en garantissant un levier de négociation décisif sur les produits pour lesquels la souveraineté n’est pas assurée par la production intérieure.

Pour le coup comme le mentionne Aldebaran dans son commentaire plus bas, la Hollande avec ses machines de lithographie montrent l’exemple. Si plusieurs pays ont une domination sur un produit essentiel de manière à ce que cela créée un marché d’échange, cela augmente le niveau de souveraineté de chacun : par la production intérieure d’abord, et ensuite parce que cette production intérieure permet et encourage (sinon contraint) la négociation entre les parties. La garantie de la collaboration de la partie dont on dépend participe aussi à la souveraineté.

On pourrait déjà commencer à produire des carte-mères…

ce commentaire est sous licence cc by 4 et précédentes

[^] # Re: Les GPUs chinois

Posté par Renault (site web personnel) . Évalué à 4 (+1/-0).

La défense c'est en général particulier car non seulement les États se battent pour les retombées économiques, mais aussi parce qu'il y a le réflexe de souveraineté qui freine la volonté de partager le contrôle sur ce secteur critique. C'est souvent ce dernier point qui bloque l'élaboration d'une réelle Europe de la défense (et de son industrie plus unifiée).

Oui, mais cela signifie que les autres États et entreprises européennes veulent bien garantir des débouchés à ces produits locaux pour permettre de financer les usines et la conception. C'est là où ça bloque, et le marché français est trop petit pour que cela se lance spontanément sans coopérations européennes.

[^] # Re: Les GPUs chinois

Posté par Shunesburg69 . Évalué à 3 (+2/-0). Dernière modification le 20 avril 2026 à 17:39.

Pas si irréaliste que ça. On a des acteurs qui s'y connaissent dans ce domaine : Thomson, Thalès… et même si maintenant ils n'en font plus leur cœur de métier, et que des puces US / Chinoises ont pris la place, ils savent très bien faire des puces dont des CPU et des GPU, ils n'ont juste plus investi là dedans depuis plusieurs décennies, mais ils pourraient très bien, avec des financements, reprendre les devant et faire des CPU/GPU Made in France.

[^] # Re: Les GPUs chinois

Posté par Renault (site web personnel) . Évalué à 4 (+2/-1).

Alors comparer ce qu'on faisait à l'époque avec ce qu'on fait aujourd'hui n'a pas je pense beaucoup de sens.

Je ne doute pas que la France pourrait en théorie y parvenir, ce n'est pas cet aspect là que je remets en question. Bon déjà malgré tout on manque de savoir et de savoir faire pour faire ces puces, il y a des gens compétents dans le domaine dans nos contrées c'est indéniable mais malgré tout peu d'entre eux ont touché à la conception et fabrication de ces puces de dernières générations donc il y a beaucoup de rattrapage à faire ne serait-ce niveau formation et connaissance. Il ne suffit pas de prendre des employés de STMicroelectronics par exemple et de leur dire "faites des puces hyper puissantes gravées en 3 nm".

Ensuite il faut construire ces usines et ces coûts sont très élevés, bien plus que de construire celles pour les puces de générations précédentes. Cela nécessite donc de l'aide d'État mais aussi des garanties de commandes si tu veux espérer voir cette usine sortir de terre. Et la France seule est probablement trop petite pour financer cette opération et apporter ce volume nécessaire.

Faire au niveau européen a du sens car déjà ça permet de pouvoir mobiliser plus de chercheurs et d'ingénieurs sur ces questions, de créer un écosystème plus vaste et parce qu'il y a aussi des ponts possible entre les activités selon les puces donc il y a moyen de partager beaucoup d'infos.

[^] # Re: Les CPUs Francais

Posté par FrancoisA30 (site web personnel) . Évalué à 1 (+1/-1). Dernière modification le 26 avril 2026 à 10:44.

En France, on conçoit des CPU Risc-V soutenu par l'Union Européenne : le Rhea-1 pour mettre dans des Data center.

https://www.lesnumeriques.com/cpu-processeur/rhea-1-ce-processeur-europeen-concu-en-france-relance-la-bataille-des-puces-face-aux-etats-unis-et-a-la-chine-n239589.html

En théorie, les écrans bleux sont rare. En pratique, les utilisateurs appellent rarement le support pour dire : Bonjour.

[^] # Re: Les CPUs Francais

Posté par Renault (site web personnel) . Évalué à 3 (+0/-0).

Oui, et ? C'est bien mais ça ne répond pas aux points soulevés.

Une partie de la conception reste de l'ARM, de même que l'outillage autour n'est pas local non plus sans parler de la fabrication. C'est le début pour faire émerger un écosystème européen mais c'est très loin de l'ambition dont on parle et de ce dont la Chine est capable aujourd'hui sur ces processeurs aussi gros.

Je dirais presque que cette avancée est la partie facile (même si ce n'est pas rien) dans l'optique d'avoir un processeur 100% européen.

[^] # Re: Les GPUs chinois

Posté par Aldebaran (site web personnel) . Évalué à 4 (+3/-0).

Je serais très curieux d'avoir dans les mains des choses comme ça et une analyse par rapport à ce que je connais (Intel et AMD en gros, un peu de soc ARM, mais c'est tout niveau archi dans mes étagères).

J'aimerais bien avoir un proc en Risc V, mais ça reste un peu délicat pour mon usage et niveau qualité prix.

C'est pour le boulot ou en perso que tu as ce matos ?

[^] # Re: Les CPUs chinois

Posté par FrancoisA30 (site web personnel) . Évalué à 1 (+0/-0). Dernière modification le 26 avril 2026 à 10:47.

Ceci dit Ubuntu cherche à ce que le les CPU Risc-V soient une plateforme officiellement supportés par leur distribution GNU/Linux.

En théorie, les écrans bleux sont rare. En pratique, les utilisateurs appellent rarement le support pour dire : Bonjour.

[^] # Re: Les CPUs chinois

Posté par BAud (site web personnel) . Évalué à 2 (+0/-0). Dernière modification le 26 avril 2026 à 11:25.

il y aurait des benchmarks pour comparer les perfs AMD / Intel, ARM, Risc-V ?

https://www.cpubenchmark.net/market_share.html 40 / 60 pour AMD / Intel ↩

https://www.cpubenchmark.net/CPU_mega_page.html trier par Thread mark pour voir Apple M5 en premier, par CPU mark pour les EPYC (mais en dual-CPU c'est un peu de la triche :p) ↩

une recherche donnes quelques benchmarks RISC-V mais pas vraiment de comparatif :/ ↩

# Addition

Posté par Aldebaran (site web personnel) . Évalué à 3 (+2/-0).

Je viens de voir ça chez Videocardz, je l'aurais bien ajouté à la partie impact sur le développement : SIGGRAPH 2025 Advances in Real-Time Rendering in Games: Fast as Hell: idTech8 Global Illumination (Youtube)

[^] # Re: Addition

Posté par Aldebaran (site web personnel) . Évalué à 1 (+0/-0).

Pareil pour ça : FSR 4.1 (extension programmée aux cartes 7000 et 6000)

Et ça : The 'Fake' Geometry of Crimson Desert: How it Really Works

[^] # Re: Addition

Posté par BAud (site web personnel) . Évalué à 3 (+1/-0).

tu peux indiquer à la modération que tu veux l'ajouter dans la partie dév mais en précisant sous quelle forme : que les liens, en les mettant à la fin ? pas de § de synthèse ?

[^] # Re: Addition

Posté par Aldebaran (site web personnel) . Évalué à 1 (+0/-0).